👓 VisionClaw : Un agent IA dans des Ray-Ban

Découvrez comment VisionClaw transforme les lunettes Meta Ray-Ban en agents IA autonomes grâce à Gemini Live, OpenClaw et une architecture zéro latence.

Date : 2026-02-23

Tags : IA, Agent IA, OpenClaw, Meta

L'écosystème technologique vient de franchir un cap critique dans la fusion entre le matériel grand public et l'intelligence artificielle autonome. Le projet open-source VisionClaw s'impose comme un véritable changement de paradigme pour les lunettes connectées Meta Ray-Ban en exploitant des capacités inédites. En combinant le SDK Meta Wearables DAT, l'API Gemini Live de Google et le framework d'exécution OpenClaw, cette solution transcende la simple assistance vocale. Elle introduit des capacités agentiques multimodales opérant en temps réel au plus près de l'utilisateur final. Ce n'est plus une simple interface passive à laquelle on pose des questions isolées. Désormais, la machine voit ce que vous voyez, entend ce que vous dites, et surtout, interagit de manière proactive avec votre environnement logiciel et physique.

Cette convergence redéfinit fondamentalement notre rapport aux objets connectés du quotidien. Elle transforme un accessoire de mode technologique largement répandu en un super-agent embarqué capable d'exécuter des flux de travail complexes. L'approche technique choisie par les développeurs pour ce projet soulève des questions fascinantes et incontournables sur l'avenir du secteur. Elle force les ingénieurs à repenser l'architecture logicielle, la gestion asynchrone des flux de données et la sécurité des exécutions automatisées. VisionClaw prouve que le matériel existant possède déjà la puissance nécessaire pour accueillir la prochaine génération d'assistants virtuels.

## Quel impact sur la latence et l'architecture réseau ?

Le principal goulot d'étranglement des dispositifs intelligents actuels réside dans le traitement asynchrone des requêtes hébergées dans le cloud. Habituellement, la voix de l'utilisateur est enregistrée, compressée, puis envoyée à un serveur distant pour subir une transcription textuelle coûteuse en temps. Ensuite, le texte est analysé par un grand modèle linguistique (LLM) avant d'être finalement synthétisé en retour audio via un processus de Text-to-Speech. VisionClaw pulvérise littéralement cette latence structurelle en utilisant une architecture de communication basée sur des flux WebSockets persistants. Le système capture l'audio brut (au format PCM) et le diffuse directement et en continu vers les serveurs de Gemini Live. Cette approche de bout en bout supprime brillamment toutes les étapes de conversion intermédiaires qui ralentissent les interactions traditionnelles. Elle offre ainsi une réactivité quasi instantanée qui s'apparente véritablement à une conversation humaine fluide et naturelle.

En parallèle de cette prouesse audio, le flux vidéo capturé par les caméras des lunettes est traité avec une frugalité particulièrement intelligente. Plutôt que de saturer inutilement la bande passante avec un flux vidéo haute définition continu, VisionClaw échantillonne les images à une fréquence d'environ une image par seconde. Ce choix de conception technique garantit une empreinte réseau minimale tout en préservant l'intégrité de l'analyse contextuelle. Il fournit au modèle multimodal suffisamment d'informations visuelles fraîches pour comprendre et analyser finement l'environnement immédiat de l'utilisateur. C'est précisément cette optimisation radicale du pipeline de données qui permet au système de fonctionner de manière fluide, même sur des connexions mobiles 4G ou 5G standard. Le défi historique de la latence n'est plus un obstacle technique, mais devient au contraire un levier de performance inégalé pour l'agent IA.

## Pourquoi l'exécution locale via OpenClaw change la donne ?

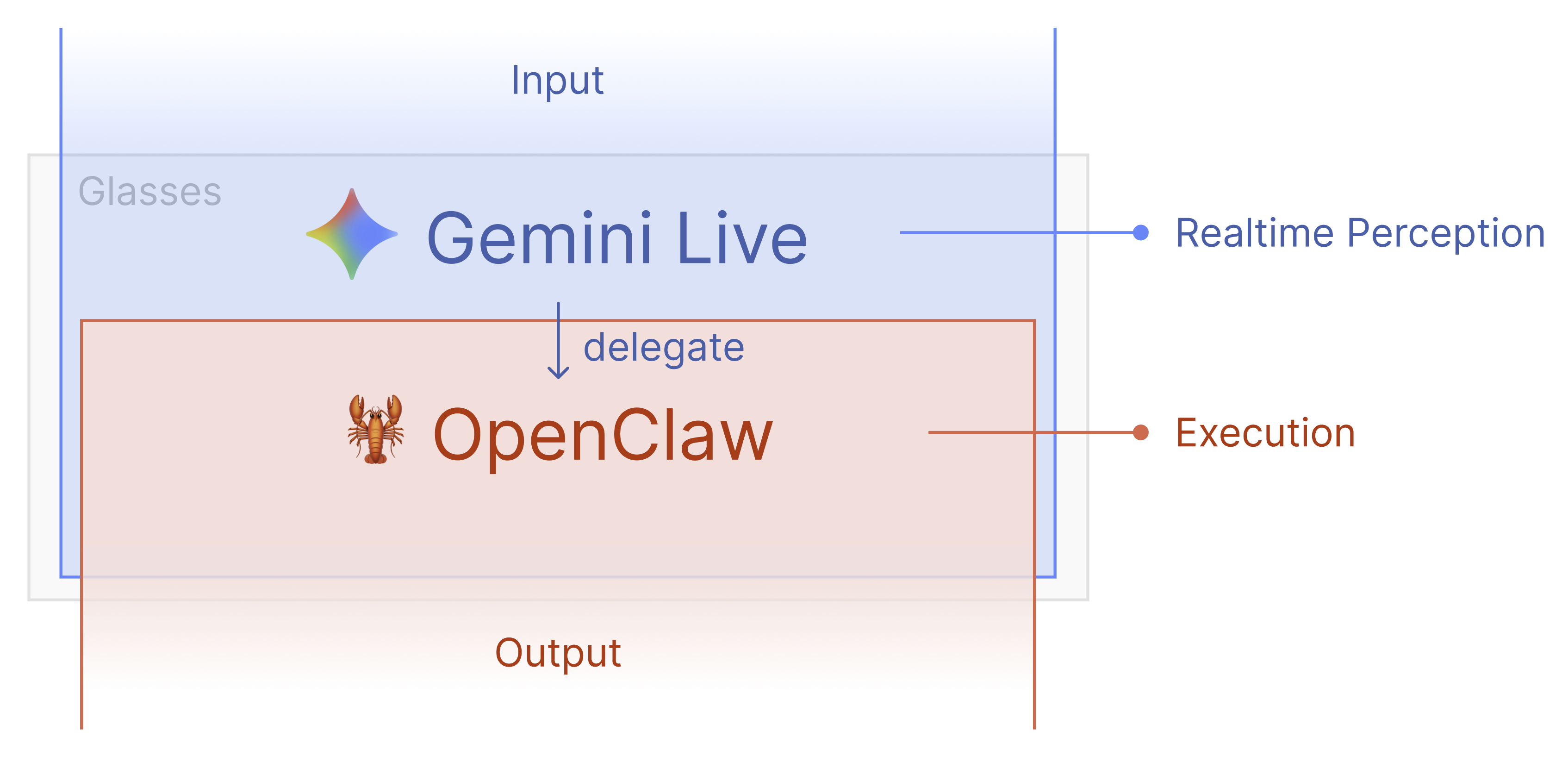

La véritable révolution architecturale de VisionClaw ne réside pas seulement dans sa capacité à \"voir\" et \"entendre\" son porteur. Son potentiel disruptif s'exprime pleinement dans sa faculté à \"agir\" concrètement sur les outils numériques de l'utilisateur. C'est exactement ici qu'intervient l'intégration optionnelle d'OpenClaw, un framework d'exécution d'outils souvent désigné sous le terme technique de Tool Calling. Lorsqu'un utilisateur formule une requête complexe comme \"Ajoute du lait à ma liste de courses\" ou \"Envoie un message pour dire que je serai en retard\", Gemini analyse l'intention initiale. Il délègue ensuite immédiatement l'action requise à OpenClaw pour la phase d'exécution finale. Contrairement aux solutions propriétaires classiques qui facturent chaque appel d'API métier, OpenClaw exécute la logique de ces compétences localement. Cette exécution s'effectue via une passerelle réseau hébergée directement sur l'ordinateur ou le serveur personnel du propriétaire des lunettes.

Cette architecture fortement décentralisée présente un double avantage, à la fois économique et purement stratégique. D'une part, elle élimine totalement les coûts marginaux liés à l'exécution sur des serveurs tiers, réduisant drastiquement les dépenses d'exploitation (OPEX) pour les développeurs. D'autre part, elle garantit une souveraineté absolue sur les flux de données et l'orchestration des tâches automatisées. Pour maîtriser cette architecture en production, c'est le sujet central de notre module [Optimiser et Automatiser son quotidien professionnel grâce au no-code et à l’IA](https://www.travelearn.fr/formation/optimiser-et-automatiser-son-quotidien-professionnel). L'exécution locale s'impose ainsi comme le nouveau standard incontournable pour les agents IA de la prochaine décennie. Elle parvient à allier avec brio la puissance de calcul des grands modèles avec la flexibilité et la rentabilité des environnements locaux.

| Métrique / Architecture | Cloud Wearable Standard | VisionClaw + OpenClaw | Gain / Avantage Stratégique |

| :--- | :--- | :--- | :--- |

| **Latence Audio (TTFB)** | > 1.5 - 2.5 secondes | < 400 millisecondes | Réduction de 80% via flux PCM / WebSocket |

| **Coûts d'Action (OPEX)** | Paiement par appel API tiers | Gratuit (Exécution locale LAN) | Économies massives à l'échelle |

| **Fréquence Visuelle** | Souvent asynchrone (sur clic) | 1 image / seconde (continu) | Contexte temps réel sans saturer la 5G |

| **Profondeur d'Intégration** | Limitée aux apps de l'écosystème | +50 outils via Clawhub | Évolutivité open-source infinie |

> \"Ce système représente le pont ultime entre nos mondes physique et digital. En transformant un équipement grand public en agent autonome, nous ne faisons pas qu'accélérer l'interaction, nous redéfinissons le concept même d'informatique ambiante.\"

> — Xiaoan (Sean) Liu, Créateur de VisionClaw

## Quels sont les risques sécuritaires des actions agentiques ?

L'octroi d'une autonomie d'action étendue à un modèle d'intelligence artificielle embarqué soulève inévitablement des défis de sécurité d'une ampleur inédite. Avec une application comme VisionClaw, la capacité de l'IA à interagir directement avec des applications de messagerie ou des systèmes domotiques crée de nouveaux vecteurs de vulnérabilité critiques. Le risque inhérent de \"hallucination\" du modèle reste la menace principale à neutraliser dans ce genre d'architecture ouverte. Dans ce scénario redouté, l'IA pourrait déclencher une action non désirée, comme envoyer un message confidentiel au mauvais contact ou valider un achat erroné sur internet. Cette perspective exige la mise en place d'une gouvernance stricte des permissions accordées à chaque outil du framework OpenClaw. La communauté technique spécialisée souligne d'ailleurs l'importance vitale d'implémenter des mécanismes de confirmation humaine pour toutes les actions jugées à haut risque.

Pour mitiger efficacement ces menaces opérationnelles, l'architecture logicielle doit intégrer des systèmes de validation particulièrement robustes et éprouvés. On pense notamment à l'intégration d'une authentification multifacteur pour les paiements ou à l'exigence d'une confirmation vocale explicite avant la suppression de données sensibles. De surcroît, l'utilisation de logiciels tiers open-source comme OpenClaw exige une vigilance accrue quant à la gestion des clés d'API et des accès au réseau local. La sécurisation de ce type de bot automatisé passe par la définition de limites strictes d'utilisation et la possibilité de révoquer facilement une commande. Le succès commercial et technique de l'IA embarquée dépendra exclusivement de notre capacité collective à équilibrer cette puissance d'automatisation avec un cadre de sécurité parfaitement infaillible.

**Sources :**

- [Repo Github](https://github.com/sseanliu/VisionClaw)

- [Reddit AI Guild](https://www.reddit.com/r/AIGuild/comments/1r7roka/visionclaw_handsfree_ai_on_meta_glasses/)