🎨 Qwen-Image-Layered : décomposez vos images en calques avec l'IA

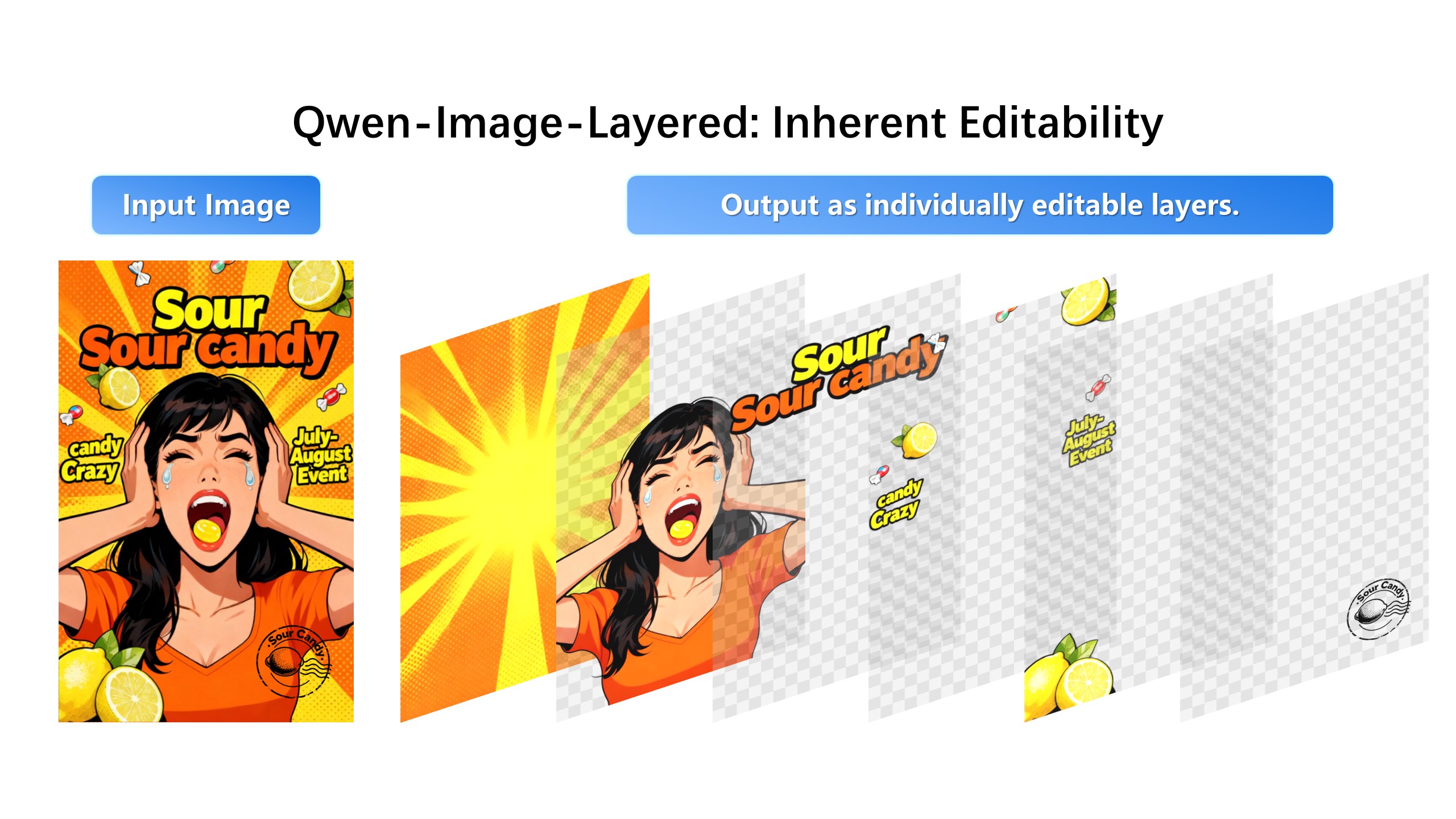

Qwen-Image-Layered transforme n'importe quelle image en calques RGBA éditables, comme Photoshop, en quelques secondes. Testable gratuitement sur HuggingFace.

Date : 2025-12-22

Tags : Image IA, IA Générative, Productivité, No-code, Open Source

L'équipe Qwen d'Alibaba vient de sortir un modèle open source qui fait quelque chose d'assez bluffant : il prend une image ordinaire et la décompose automatiquement en calques séparés, comme si elle avait été créée sur Photoshop. Vous pouvez tester le modèle directement sans rien installer sur le [Space HuggingFace officiel de Qwen-Image-Layered](https://huggingface.co/spaces/Qwen/Qwen-Image-Layered).

## C'est quoi Qwen-Image-Layered exactement ?

Qwen-Image-Layered est un modèle de diffusion développé par l'équipe Qwen chez Alibaba, annoncé le 19 décembre 2025. Son principe est simple à comprendre, même si la technique derrière est complexe : vous lui donnez une image JPG ou PNG classique, et il vous retourne entre 3 et 8 calques RGBA séparés, chacun avec son propre canal de transparence. Un calque pour le sujet principal, un pour le texte, un pour l'arrière-plan, un pour les objets au premier plan, et ainsi de suite. Ce que les graphistes font à la main en Photoshop en plusieurs heures, le modèle le fait en quelques secondes. L'approche est ce qu'on pourrait appeler du "reverse design" : au lieu de construire une image couche par couche, on part du résultat final et on remonte le processus de création. C'est une idée simple mais dont les implications pratiques sont énormes pour quiconque travaille avec des visuels au quotidien.

## Comment ça marche techniquement ?

Le modèle repose sur deux composants clés. Le premier est un RGBA-VAE, un encodeur qui comprend à la fois les images opaques classiques (RGB) et les images avec transparence (RGBA) dans un même espace de représentation. C'est ce qui permet au modèle de générer des calques avec des contours nets et des zones de transparence précises, sans perdre les détails des bords. Le second est l'architecture VLD-MMDiT (Variable Layers Decomposition Multi-Modal Diffusion Transformer), qui gère la séparation elle-même. Contrairement aux modèles à sortie fixe, il adapte le nombre de calques produits à la complexité de l'image : 3 calques pour une scène simple, jusqu'à 8 pour une composition dense avec du texte, plusieurs objets et des superpositions. Le modèle a été entraîné en plusieurs étapes, en partant d'un générateur d'images standard puis en l'adaptant progressivement à la décomposition sémantique, notamment en s'appuyant sur une base de fichiers Photoshop PSD réels pour l'entraînement. Ce qui le distingue fondamentalement des outils de détourage classiques comme Remove.bg, c'est qu'il ne se contente pas de masquer des zones. Il comprend sémantiquement ce que représente chaque élément, et il peut même reconstruire les parties cachées d'un objet derrière un autre, en inférant ce qui se trouve derrière.

## Qwen-Image-Layered vs les outils classiques : ce qui change vraiment

| Outil | Type | Calques | Transparence | Cohérence d'édition | Accès |

|---|---|---|---|---|---|

| Qwen-Image-Layered | Modèle IA diffusion | 3 à 8 | RGBA natif | Quasi-zéro dérive | Open source / API |

| Remove.bg | Masque binaire | 1 (fond/sujet) | Alpha basique | Pas d'édition | Freemium |

| Segment Anything (SAM) | Segmentation | Multiple | Masques | Nécessite pipeline | Open source |

| Photoshop (manuel) | Edition manuelle | Illimité | Complet | Dépend du graphiste | Payant |

| Firefly / Generative Fill | Diffusion globale | 0 (flat) | Non natif | Dérive fréquente | Payant |

Le problème que Qwen-Image-Layered résout, c'est la dérive de cohérence. Quand vous éditez une image avec un modèle de diffusion classique, retoucher un élément peut "contaminer" le reste de la composition : un visage qui change légèrement, un arrière-plan qui se déforme. Avec des calques physiquement isolés, chaque modification reste cantonnée à son calque. Vous redimensionnez un personnage, le fond reste intact. Vous changez la couleur d'un objet, les autres calques ne bougent pas d'un pixel.

> "Les pixels étaient la mauvaise abstraction depuis le début. Les éditeurs basés sur la diffusion traitent toujours les images comme un canvas RGB plat. Qwen-Image-Layered règle le problème au niveau de la représentation, pas en patchant les symptômes."

> Mehul Gupta, Data Science in Your Pocket

## Qui peut vraiment en profiter ?

Les cas d'usage les plus immédiats concernent les créatifs qui travaillent sans équipe technique. Un indépendant qui crée des visuels pour les réseaux sociaux peut récupérer les calques d'une photo existante et les réutiliser dans de nouveaux formats sans tout refaire. Un responsable marketing peut modifier le texte d'une bannière publicitaire sans toucher au visuel. Un formateur peut décomposer une infographie pédagogique pour en animer les éléments un par un. La décomposition peut aussi être appliquée de façon récursive : chaque calque obtenu peut lui-même être redécomposé en sous-calques, ce qui ouvre la voie à une édition très granulaire. Le modèle fonctionne sur n'importe quelle image RGB, qu'il s'agisse d'une photo, d'une illustration générée par IA, ou d'une capture d'écran. À noter tout de même : pour l'utiliser en local, il faut une GPU avec au moins 8 Go de VRAM, et le modèle pèse environ 57 Go. Pour la plupart des usages, l'interface HuggingFace Spaces ou les API tierces (fal.ai, Pixazo) sont la solution la plus accessible.

## Comment tester et utiliser Qwen-Image-Layered

| Méthode | Prérequis | Coût | Idéal pour |

|---|---|---|---|

| HuggingFace Spaces | Aucun | Gratuit | Tester sans installer |

| API fal.ai / Pixazo | Compte | Payant à l'usage | Intégration projet |

| Gradio local | GPU 8 Go VRAM, Python | Gratuit | Développeurs |

| ComfyUI | GPU, ComfyUI installé | Gratuit | Workflows avancés |

Pour démarrer immédiatement, le plus simple est le [Space HuggingFace](https://huggingface.co/spaces/Qwen/Qwen-Image-Layered) : vous uploadez une image, vous choisissez le nombre de calques souhaité (3 ou 8), et le modèle vous retourne les fichiers RGBA séparés en quelques secondes. Le code et les poids du modèle sont disponibles sur GitHub et HuggingFace sous licence Apache 2.0, ce qui signifie une utilisation libre, y compris commerciale.

Sinon, la maîtrise des outils IA de génération et d'édition d'images fait partie des compétences abordées dans la formation [Augmenter sa productivité et créativité à l'aide de l'IA](https://www.travelearn.fr/formation/augmenter-sa-productivit-et-crativit-laide-de-lintelligence-artificielle) de TraveLearn.

## FAQ

**Est-ce que Qwen-Image-Layered est vraiment gratuit ?**

Oui, le modèle est open source sous licence Apache 2.0. Les poids sont disponibles sur HuggingFace et ModelScope sans restriction commerciale. L'utilisation via les API tierces (fal.ai, Pixazo) est payante à l'usage, mais des crédits gratuits sont souvent disponibles au démarrage.

**Quelle différence avec un simple outil de détourage ?**

Un outil de détourage crée un masque binaire (fond/sujet). Qwen-Image-Layered produit entre 3 et 8 calques sémantiquement distincts, chacun avec un canal alpha précis. Il comprend ce que représente chaque élément et peut reconstruire les parties masquées d'un objet, ce qu'aucun outil de masquage classique ne fait.

**Le modèle fonctionne-t-il avec des photos prises au smartphone ?**

Oui, il accepte n'importe quelle image RGB standard. Les photos réelles fonctionnent bien, bien que les scènes avec des objets transparents ou réfléchissants (verre, eau) restent plus difficiles à décomposer correctement.

**Peut-on l'utiliser sans savoir coder ?**

Oui, via le Space HuggingFace ou les interfaces ComfyUI. Aucune ligne de code n'est nécessaire pour tester le modèle ou pour l'intégrer dans un workflow de création visuelle.

---

**Sources**

- [GitHub Qwen-Image-Layered](https://github.com/QwenLM/Qwen-Image-Layered)

- [Paper arXiv 2512.15603](https://arxiv.org/abs/2512.15603)

- [HuggingFace Spaces — tester en ligne](https://huggingface.co/spaces/Qwen/Qwen-Image-Layered)

- [DataCamp — Guide pratique](https://www.datacamp.com/tutorial/qwen-image-layered)