💻 Ollama App : l’IA générative locale arrive enfin sur votre ordinateur

Ollama lance une app desktop pour exécuter des IA localement sur Mac et PC. Une révolution pour la confidentialité et la souveraineté numérique.

Date : 2025-08-01

Tags : IA, LLM, Open Source

Utiliser l’intelligence artificielle sans dépendre d’OpenAI ou Google ? C’est désormais possible, même pour le grand public. **Ollama** lance une nouvelle application desktop qui permet de faire tourner des modèles d’IA localement sur Mac et Windows. Une avancée majeure pour la **souveraineté numérique**, la confidentialité et l’accessibilité de l’IA.

### Une IA qui tourne vraiment sur votre machine

L'application Ollama permet d’exécuter des **modèles de langage de grande taille (LLM)** comme Llama 3, Mistral ou Phi-3 directement sur votre ordinateur, sans avoir besoin d’une connexion permanente à internet ni d’envoyer vos données à des serveurs externes.

Chaque modèle est téléchargé localement puis exécuté en temps réel grâce à l’optimisation GPU ou CPU. Résultat : **réponses instantanées**, même hors-ligne, sans dépendance à un cloud tiers.

Ce fonctionnement garantit une **confidentialité maximale**, puisque rien ne transite vers l’extérieur. Vous contrôlez intégralement vos données, vos prompts, vos résultats.

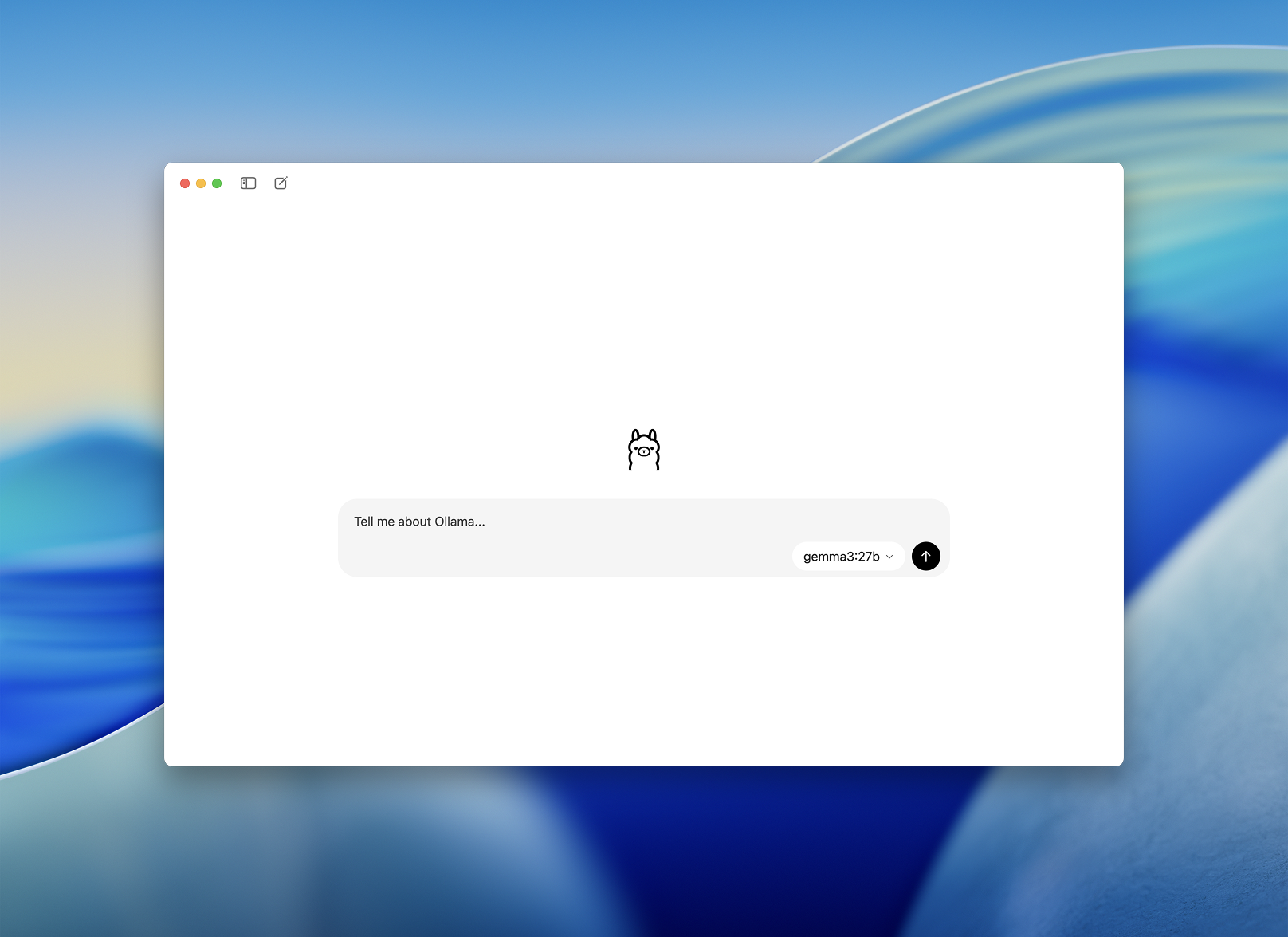

### Une interface épurée, pensée pour tous

Jusqu’ici, Ollama était réservé aux développeurs via une interface en ligne de commande. Cette nouvelle app change la donne.

L’interface est minimaliste, propre, rapide. Elle permet :

- de sélectionner le modèle de votre choix (Llama 3, Mistral, Codellama, Phi-3, etc.) ;

- de configurer les paramètres comme la température ou le nombre de tokens ;

- de voir l’historique de vos conversations ;

- et même d’utiliser plusieurs modèles en parallèle pour comparer leurs réponses.

Vous pouvez également créer vos **propres modèles personnalisés** (fine-tuning) ou charger des modèles tiers disponibles sur le hub Ollama.

### Pourquoi c’est une révolution pour les professionnels

Les entreprises sensibles (santé, droit, R&D) hésitent à utiliser ChatGPT ou Claude à cause des problèmes de confidentialité. Avec Ollama, elles peuvent :

- faire tourner leurs modèles sur leurs propres machines ;

- **éviter toute exposition de données** confidentielles ;

- **adapter leurs IA à leur métier**, sans coût d’infrastructure cloud.

De plus, le fonctionnement local permet une **meilleure réactivité** dans les workflows, particulièrement en développement logiciel, automatisation ou traitement de texte complexe.

### Performances et compatibilité

L’app Ollama fonctionne sur **Mac et Windows**, avec des performances impressionnantes sur les machines récentes (Mac M1/M2/M3, PC avec GPU NVIDIA ou AMD).

Chaque modèle prend quelques secondes à s’installer, le téléchargement est automatique, et les ressources sont gérées efficacement pour ne pas saturer votre système.

Pour les machines plus modestes, Ollama propose aussi des **versions quantisées** (Q4, Q8...) des modèles, moins gourmandes en RAM et plus rapides à exécuter.

### Une alternative crédible à ChatGPT, local et open source

Ce lancement marque une étape importante dans la démocratisation de l’**IA libre et locale**. Là où ChatGPT ou Gemini enferment leurs modèles dans des silos, Ollama ouvre la voie à une utilisation décentralisée, **open source**, et **éthique**.

Avec des modèles comme Llama 3 qui rivalisent déjà avec GPT-3.5, et une interface accessible à tous, Ollama rend l’IA générative **plus transparente, plus responsable, et plus durable**.

L’application est téléchargeable gratuitement depuis [ollama.com](https://ollama.com/download), et son code reste partiellement open source. Un compromis intéressant pour ceux qui veulent l’équilibre entre performance, maîtrise et simplicité.