🤖 LangChain Deep Agents : la fin des agents superficiels

LangChain lance Deep Agents : 4 piliers (planning, subagents, filesystem, prompt) pour construire des agents IA autonomes capables de tenir sur des tâches longues et complexes.

Date : 2026-03-16

Tags : IA, Agent IA, Automatisation, LLM

Les agents IA d'aujourd'hui ont un problème qu'on n'avait pas vraiment anticipé au moment où tout le monde s'enthousiasmait pour les premiers chatbots capables d'appeler des outils. Ces agents sont, pour la plupart, superficiels. Ils tournent en boucle, appellent un outil, récupèrent une réponse, et recommencent. C'est suffisant pour des tâches simples, mais dès qu'une mission devient complexe, qu'elle s'étale dans le temps, qu'elle nécessite de planifier plusieurs étapes en parallèle, l'architecture s'effondre. C'est exactement ce problème que LangChain a décidé d'attaquer de front avec la sortie de **Deep Agents**, une librairie open source pensée pour construire des agents autonomes et durables.

## Pourquoi les agents classiques finissent-ils par "perdre le fil" ?

Quand un LLM, c'est-à-dire un grand modèle de langage, opère en boucle simple, il souffre d'un problème structurel : la **fenêtre de contexte** (context window) se remplit très vite. Chaque appel d'outil, chaque résultat retourné, chaque étape intermédiaire consomme des tokens. Après quelques dizaines d'actions, le modèle commence à "oublier" ce qu'il a fait au début de la session. Il perd le fil de l'objectif global, répète des actions déjà réalisées, ou prend des décisions incohérentes avec ce qui précède. Harrison Chase, CEO de LangChain, a lui-même nommé ce phénomène : les agents naïfs sont "shallow", autrement dit peu profonds, incapables de plonger dans des tâches complexes qui s'étalent dans le temps. Ce n'est pas un problème de modèle, c'est un problème d'architecture. Et c'est précisément la raison pour laquelle des systèmes comme Claude Code, Deep Research d'OpenAI, ou encore Manus ont tous développé des mécanismes similaires pour contourner cette limite.

> "Les agents naïfs échouent à planifier sur des horizons temporels plus longs et à accomplir des tâches plus complexes. Deep Research, Manus et Claude Code ont tous résolu ce problème de la même façon : un outil de planification, des sous-agents, un accès au système de fichiers, et un prompt détaillé."

>

> **Harrison Chase, CEO & co-fondateur de LangChain**

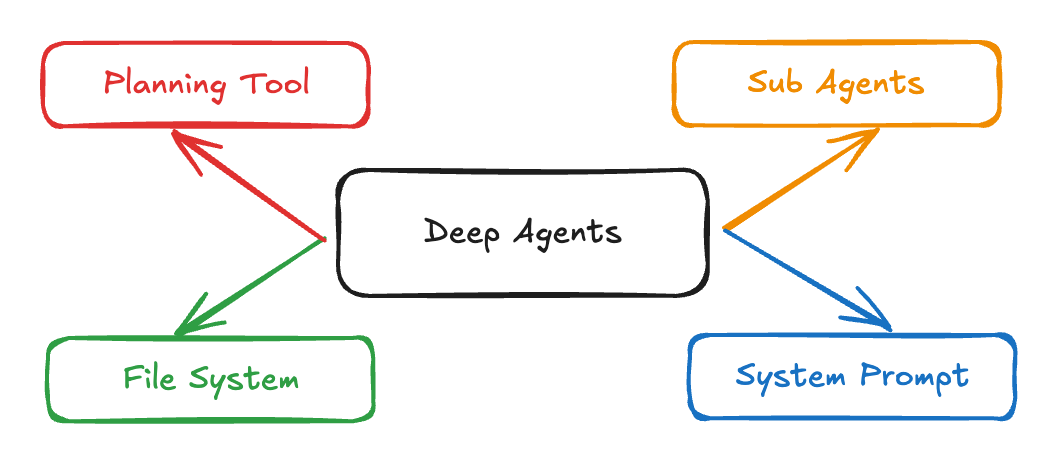

## Qu'est-ce qui rend un Deep Agent réellement "profond" ?

LangChain a analysé ce que ces systèmes avaient en commun et en a extrait quatre piliers fondamentaux. Le premier est le **prompt système détaillé** (detailed system prompt). Les meilleurs agents de coding et de recherche ont tous des prompts système très longs, avec des instructions explicites sur l'usage des outils et des exemples de comportements attendus (on parle de "few-shot prompting"). Sans ce niveau de détail, le modèle manque de guidage et ses performances s'effondrent rapidement. Le deuxième pilier est l'**outil de planification** (planning tool). Dans Claude Code, cet outil prend la forme d'une liste de tâches à faire. Chose surprenante : techniquement, il ne fait rien, c'est un outil "no-op" (no operation). Il sert uniquement à forcer le modèle à exprimer son plan de manière explicite, ce qui améliore considérablement la cohérence sur le long terme. Le troisième pilier, les **sous-agents** (subagents), est peut-être le plus puissant : plutôt que de tout faire dans un seul contexte qui se pollue, l'agent principal délègue des sous-tâches à des agents spécialisés qui opèrent dans leur propre fenêtre de contexte isolée. Le quatrième et dernier pilier est l'accès à un **système de fichiers virtuel** (virtual filesystem), qui permet à l'agent de stocker des notes, des résultats intermédiaires, ou de la mémoire persistante sans encombrer son contexte principal.

| Pilier | Rôle | Analogie humaine |

|---|---|---|

| Prompt détaillé | Guider le comportement général de l'agent | Manuel de travail |

| Planning tool (no-op) | Forcer la structuration des étapes | Liste de tâches |

| Sous-agents | Déléguer et isoler les contextes | Équipe spécialisée |

| Système de fichiers | Mémoire persistante hors contexte | Bloc-notes de chantier |

| Backends pluggables | Connecter n'importe quel stockage | Disque dur amovible |

| Composite backends | Mixer plusieurs sources de stockage | Répertoire partagé multi-serveurs |

Deep Agents est disponible via `pip install deepagents` et se lance en quelques lignes de Python. L'API est volontairement minimaliste : on passe un modèle, des outils personnalisés, et un prompt d'instructions. Le reste, le plan, les sous-agents, la gestion du fichier système, est déjà câblé. C'est ce que LangChain appelle un **"agent harness"**, un harnais d'agent, par opposition au framework (LangChain) qui fournit les briques de base, et au runtime (LangGraph) qui gère l'exécution durable et le contrôle humain dans la boucle. Les trois s'empilent : LangGraph en dessous, LangChain au milieu, Deep Agents au-dessus.

## Comment LangChain utilise ses propres Deep Agents en production ?

La meilleure preuve qu'une technologie fonctionne, c'est quand son créateur l'utilise en interne sur des enjeux réels. LangChain a publié le détail de son propre agent commercial (GTM agent, pour "Go-To-Market") construit avec Deep Agents. Les résultats parlent d'eux-mêmes : entre décembre 2025 et mars 2026, le taux de conversion de leads en opportunités qualifiées a augmenté de **250%**, et les commerciaux économisent **40 heures par mois** grâce à l'automatisation de la recherche et de la personnalisation des prises de contact. Le système opère sur des données hétérogènes, transcriptions de réunions, données CRM, recherches web, et c'est précisément là que Deep Agents excelle : quand les entrées sont volumineuses et structurellement variées, le système de fichiers virtuel absorbe les grands résultats d'outils automatiquement, sans logique de troncature à coder à la main. Des sous-agents spécialisés s'occupent en parallèle de la recherche Apollo/BigQuery et de l'analyse Salesforce/Gong. Tout est supervisé via LangSmith, l'outil d'observabilité de LangChain, avec un système d'approbation humaine dans Slack avant chaque envoi.

C'est dans cette logique de montée en compétences sur les agents autonomes que la formation [AI Engineer de TraveLearn](https://www.travelearn.fr/formation/ai-engineer) prend tout son sens. Concevoir un agent qui délègue, planifie, et persiste dans le temps sur des tâches complexes demande bien plus qu'une connaissance théorique des LLMs : cela exige de comprendre l'architecture multi-couches (runtime, framework, harness), de maîtriser la gestion de contexte, et de savoir instrumenter ses agents pour les observer et les améliorer en continu.

La version **0.2** de Deep Agents, sortie fin octobre 2025, a introduit la notion de **backends pluggables** (pluggable backends). Auparavant, le système de fichiers virtuel était uniquement basé sur l'état LangGraph, ce qui limitait la persistance aux sessions actives. Désormais, on peut connecter n'importe quel système de stockage : disque local, base de données via LangGraph Store, bucket S3 pour la mémoire long terme. La fonctionnalité de **composite backends** permet même de combiner plusieurs sources : un dossier `/memories/` peut pointer vers S3 tandis que le reste du filesystem est en local. Cette modularité change fondamentalement le profil d'usage de Deep Agents, qui passe d'un prototype pratique à un outil sérieusement envisageable en production.

---

**Sources**

- [Deep Agents, blog officiel LangChain](https://blog.langchain.com/deep-agents/)

- [Doubling down on Deep Agents (v0.2)](https://blog.langchain.com/doubling-down-on-deepagents/)

- [Deep Agents documentation officielle](https://docs.langchain.com/oss/python/deepagents/overview)

- [GitHub deepagents](https://github.com/langchain-ai/deepagents)

- [LangChain GTM Agent case study](https://blockchain.news/news/langchain-gtm-agent-250-percent-conversion-boost-deep-agents)