🧠 Ingénierie du contexte : dépasser les prompts pour libérer la puissance de l'IA

Découvrez comment l'ingénierie du contexte révolutionne l'usage de l'IA en optimisant ce qu'elle « pense » plutôt que comment on lui parle.

Date : 2025-07-09

Tags : Guide, IA, Prompt Engineering, Productivité, Formation IA

Depuis que les intelligences artificielles basées sur les grands modèles de langage (LLM) comme ChatGPT sont apparues, la notion de prompt, c’est-à-dire la manière de formuler nos instructions, est devenue centrale. Le « prompt engineering » consiste à concevoir et optimiser ces requêtes pour obtenir des résultats plus pertinents et précis.

Cependant, avec l'augmentation spectaculaire de la taille des fenêtres de contexte — passant de 4 000 à plus d'un million de tokens en seulement deux ans — une nouvelle discipline a émergé : <i>l'ingénierie du contexte</i>. Ce concept, popularisé notamment par Tobi de Shopify, transcende la simple optimisation des questions et s'intéresse à ce que l'IA peut réellement « penser » grâce à ce à quoi elle a accès.

### Qu'est-ce qu'une fenêtre de contexte ?

Imaginez une vaste feuille blanche que vous passez à l'IA. Vous pouvez y écrire un certain nombre de mots : une simple demande poétique, ou un long texte de plusieurs milliers de mots que vous souhaitez résumer. Cette feuille correspond à la fenêtre de contexte de l'IA.

Cette fenêtre est limitée en taille, mesurée en tokens ; un token étant environ trois quarts d’un mot anglais. Ainsi, "ChatGPT" compte pour deux tokens : "Chat" et "GPT". Cette limitation influence directement le coût, la rapidité, et la capacité de mémoire de l’IA.

Les modèles de langage ne savent rien en dehors de ce pour quoi ils ont été entraînés, et de ce qu’ils reçoivent dans cette fenêtre de contexte. L’augmentation de la taille de cette fenêtre a rendu possible d’inclure des documents plus volumineux, plus riches et plus nombreux.

### Comment l'IA se souvient-elle de votre conversation ?

Si vous avez déjà utilisé ChatGPT ou Claude, vous avez probablement constaté leur capacité à se souvenir du fil de la conversation. Cette mémoire à court terme fonctionne par l’insertion dans la fenêtre de contexte des échanges précédents — prompts et réponses — ce qui permet à l’IA de garder la continuité de la discussion.

Ce fonctionnement rappelle le film "Memento", où le personnage principal écrit des notes sur son corps pour se rappeler des informations cruciales, malgré sa mémoire défaillante.

### L’évolution de l’ingénierie des prompts vers l’ingénierie du contexte

La mode de l’ingénierie des prompts en 2023, avec ses postes très payés, a démontré que beaucoup pouvaient apprendre à "parler LLM" sans diplôme informatique.

Mais cette profession n’est pas devenue aussi répandue que prévu, car finalement, tout le monde s’est mis à optimiser ses prompts. L’ingénierie du contexte va bien au-delà : elle consiste à sélectionner, organiser et fournir à l’intelligence artificielle le bon ensemble d’informations et d’outils pour qu’elle puisse raisonner efficacement.

L’ingénierie du contexte, c’est comme être un bibliothécaire qui choisit quels livres un lecteur pourra consulter avant même qu’il commence à lire.

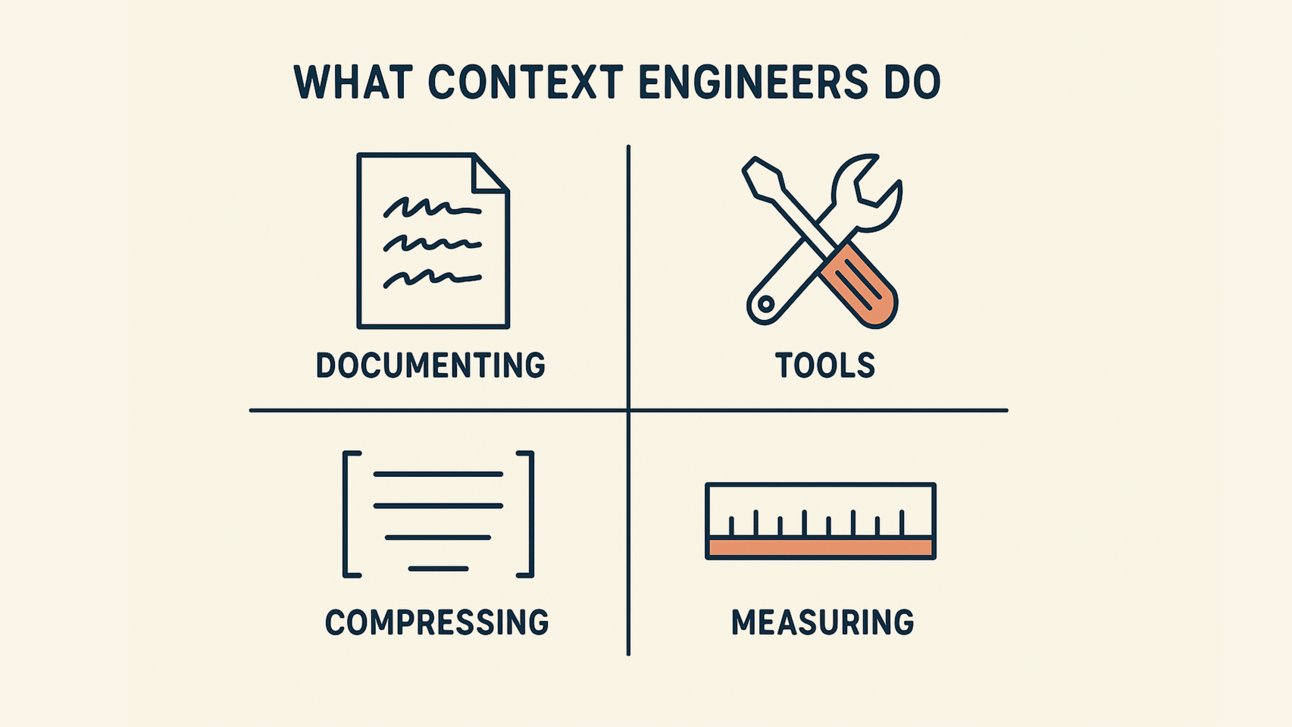

### Que fait un ingénieur du contexte ?

- **Curation** : il choisit les documents, historiques, API, ou données nécessaires pour chaque tâche.

- **Structuration** : il organise l’ordre des messages systémiques, outils, données récupérées, puis le prompt utilisateur.

- **Compression** : il résume ou segmente les données pour respecter la limite en tokens tout en préservant l'essentiel.

- **Évaluation** : il vérifie la pertinence des informations et évite la dilution du contexte par des données inutiles.

Plus le contexte est étendu, plus les documents et conversations sont riches, mais cela augmente aussi les coûts et la latence. Ce défi ouvre de nombreuses opportunités pour définir les meilleures pratiques d’ingénierie du contexte.

Cette discipline requiert une réflexion approfondie sur l’architecture de l’information, la stratégie des données et l’expérience utilisateur — des dimensions peu abordées par le prompt engineering.

### Vers un futur où le contexte prime

L’apprentissage du prompt engineering nous a montré que les compétences les plus précieuses en IA ne résident pas dans des phrases secrètes, mais dans la capacité à concevoir des systèmes intelligents qui ont accès au bon savoir au bon moment.

C’est une révolution : on passe de l’optimisation des phrases à celle de la connaissance. Cela change la donne pour tous ceux qui développent aujourd’hui avec l’intelligence artificielle.

Personnellement, en participant au développement d’une plateforme comme [agent.ai](https://agent.ai?utm_source=simple.ai&utm_medium=referral&utm_campaign=context-engineering-going-beyond-prompts-to-push-ai), je mesure chaque jour le potentiel décuplé quand on considère l’IA non plus comme un simple chatbot, mais comme une machine de raisonnement dotée du bon contexte et des bons outils.

<b>L’époque du prompt engineering nous a appris à dialoguer avec l’IA. L’ère de l’ingénierie du contexte nous apprend à penser avec l’IA.</b>

---

En conclusion, maîtriser l’ingénierie du contexte est une compétence clé pour exploiter pleinement les capacités des intelligences artificielles modernes. Pour approfondir ces concepts et acquérir les compétences pratiques nécessaires, découvrez la formation certifiée de TraveLearn dédiée à l’IA, la productivité et la créativité : [Formations IA chez TraveLearn](/formation/augmenter-sa-productivit-et-crativit-laide-de-lintelligence-artificielle).

Vous pourrez y apprendre à structurer efficacement le contexte pour tirer le meilleur des outils d’IA, booster votre créativité et votre autonomie numérique.