🖥️ Votre IA privée, gratuite et hors ligne

Ollama et Gemma 4 permettent de faire tourner une IA sur votre ordinateur en quelques clics. Zéro terminal, zéro abonnement, zéro donnée envoyée au cloud.

Date : 2026-04-13

Tags : Guide, Open Source, LLM, Google, Productivité, IA Générative

Vous utilisez ChatGPT ou Claude au quotidien. Mais à chaque fois que vous tapez quelque chose, cette phrase part sur les serveurs d'une entreprise américaine. Votre question sur votre client, votre contrat, votre idée de produit, votre situation personnelle. Tout transite vers le cloud avant de vous revenir.

Il existe une alternative, et elle ne nécessite ni compétences techniques, ni terminal, ni abonnement payant. Voici comment installer une IA directement sur votre ordinateur, en quelques clics, et commencer à l'utiliser comme n'importe quelle application.

## Une IA sur votre ordinateur : qu'est-ce que ça veut dire concrètement ?

Quand vous ouvrez ChatGPT, votre message voyage sur internet jusqu'aux serveurs d'OpenAI, qui font tourner un modèle gigantesque, puis vous renvoient une réponse. Vous n'avez aucun contrôle sur ce qui se passe entre les deux.

Faire tourner une IA en local, c'est l'inverse : le modèle s'installe sur votre disque dur, comme Word ou Photoshop. Quand vous lui posez une question, la réponse est calculée par votre propre processeur ou carte graphique. Rien ne sort de votre machine.

Les avantages sont immédiats :

- **Confidentialité totale** : ce que vous écrivez reste sur votre ordinateur. Utile pour les documents sensibles, les données clients, les projets internes.

- **Gratuit à l'usage** : une fois le logiciel installé et le modèle téléchargé, chaque conversation ne coûte rien.

- **Hors connexion** : ça fonctionne dans le train, en déplacement, sans wifi.

- **Pas d'abonnement** : pas de 20 euros par mois, pas de limite de messages.

La contrepartie honnête : les modèles locaux, même les meilleurs d'aujourd'hui, n'atteignent pas encore le niveau de Claude Sonnet ou GPT-4o sur les tâches très complexes. Pour résumer un long document, rédiger un email, reformuler un texte, préparer un entretien ou répondre à des questions courantes, ils font largement le travail.

## Ce qu'est Ollama : une télécommande pour modèles IA

Ollama est un logiciel gratuit et open source qui sert d'intermédiaire entre vous et les modèles d'IA. Son rôle : télécharger les modèles, les faire tourner sur votre machine, et vous proposer une interface de chat.

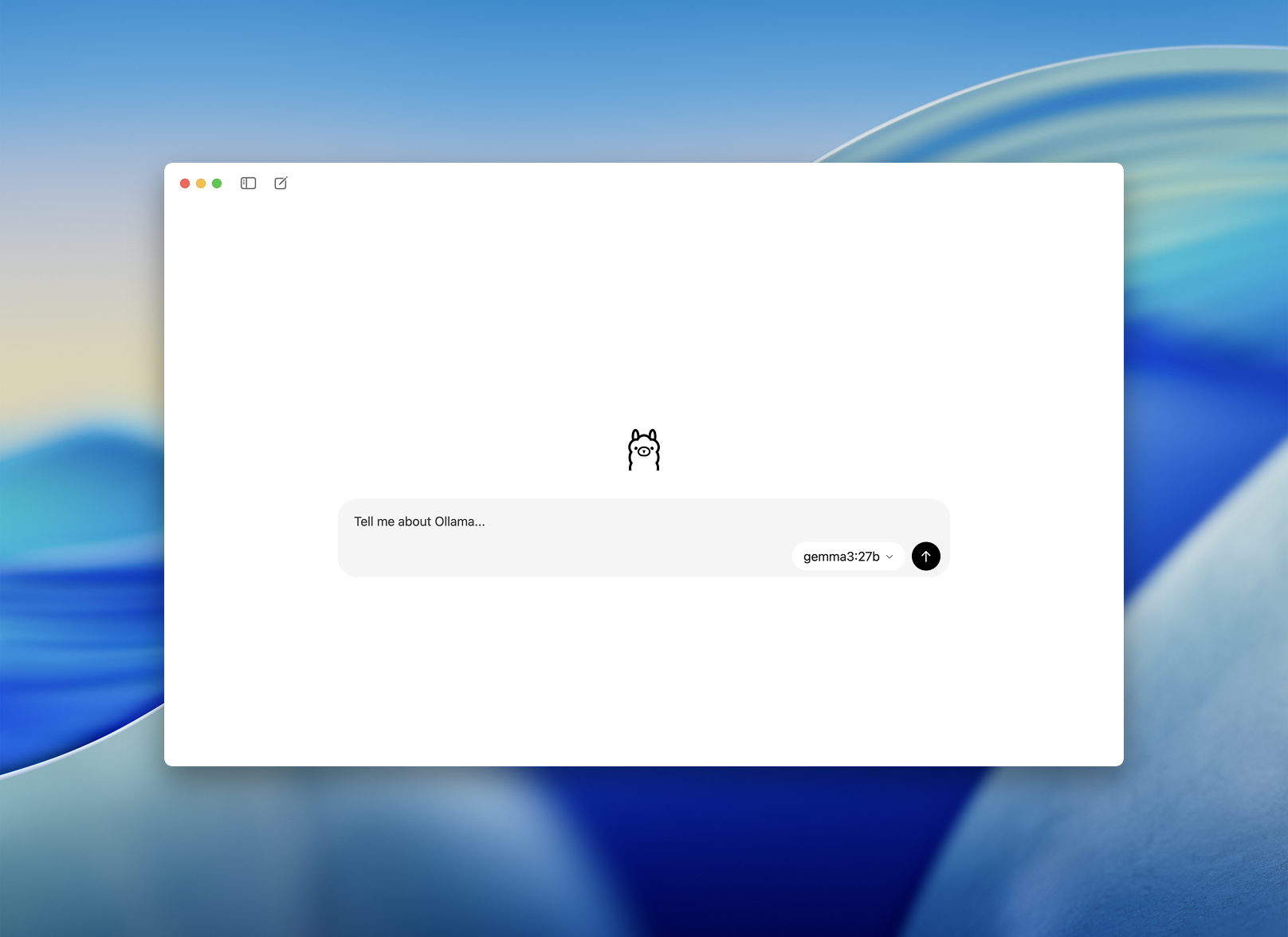

Depuis la version 0.10.0 sortie en juillet 2025, Ollama propose une application de bureau native pour macOS et Windows, sans terminal requis. Vous installez, vous ouvrez, vous choisissez un modèle, vous discutez. C'est aussi simple que ça.

Ollama tourne nativement sur macOS (Apple Silicon et Intel) et Windows 10/11. L'installation se fait comme pour n'importe quelle application classique.

## Quel modèle choisir ? Gemma 4, le meilleur rapport qualité/machine de 2026

Un modèle d'IA, c'est un fichier (souvent plusieurs gigaoctets) qui contient toute l'intelligence du système. Plusieurs modèles sont disponibles via Ollama. En avril 2026, le meilleur choix pour un usage quotidien est **Gemma 4**, sorti par Google DeepMind.

Pourquoi Gemma 4 plutôt que les autres ?

Gemma 4 est sorti le 2 avril 2026 sous licence Apache 2.0, ce qui signifie utilisation commerciale libre, sans royalties ni restrictions. Ollama a livré un support natif complet moins de 24 heures après la sortie.

Le bond par rapport à la génération précédente est concret : sur les benchmarks de raisonnement scientifique, Gemma 4 31B passe de 42,4 % à 84,3 %. Sur les tests de coding compétitif, de 29,1 % à 80,0 %. Pour un usage bureautique courant, rédaction, résumé, questions-réponses, la différence se ressent.

Le modèle recommandé selon votre ordinateur :

| Votre machine | Modèle à choisir | Poids à télécharger |

|---|---|---|

| Ordinateur portable standard (8-16 Go RAM) | Gemma 4 E4B | 9,6 Go |

| Mac avec puce M1/M2/M3/M4 (16 Go+) | Gemma 4 26B | 18 Go |

| PC de bureau avec bonne carte graphique | Gemma 4 26B ou 31B | 18-20 Go |

| Ordinateur ancien ou peu de RAM | Gemma 4 E2B | 7,2 Go |

Si vous ne savez pas quelle configuration vous avez : le modèle **E4B** fonctionne sur la grande majorité des ordinateurs achetés ces 5 dernières années.

## Comment installer Ollama et lancer Gemma 4 : le pas à pas en images

### Étape 1 : télécharger Ollama

Rendez-vous sur [ollama.com](https://ollama.com/download) et cliquez sur le bouton correspondant à votre système (macOS ou Windows). Vous obtenez un fichier d'installation classique.

Sur Mac : ouvrez le fichier `.dmg`, faites glisser l'icône Ollama dans votre dossier Applications, puis double-cliquez pour lancer.

Sur Windows : double-cliquez sur le fichier `.exe` téléchargé et suivez les étapes d'installation habituelles.

Aucune configuration en ligne de commande n'est nécessaire pour démarrer.

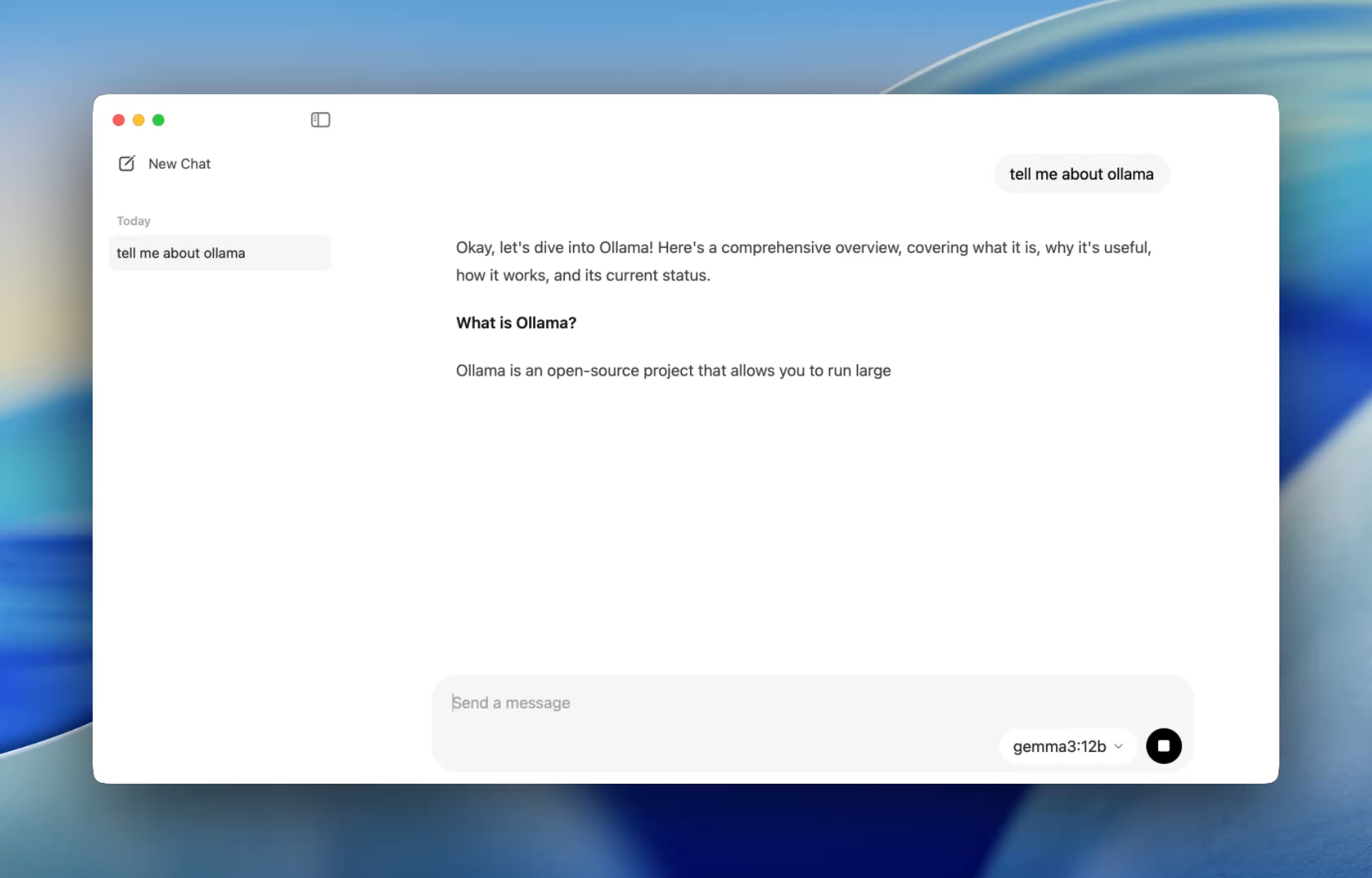

### Étape 2 : choisir et télécharger Gemma 4

Au premier lancement, Ollama vous propose de choisir un modèle. Dans la liste ou dans la barre de recherche, tapez **gemma4** et sélectionnez le variant correspondant à votre machine (voir le tableau ci-dessus). Ollama lance le téléchargement automatiquement.

Comptez 10 à 30 minutes selon votre connexion, le temps que le fichier s'installe. C'est un téléchargement unique, comme n'importe quel logiciel.

### Étape 3 : commencer à discuter

Une fois le modèle chargé, une interface de chat s'ouvre. Elle ressemble exactement à ChatGPT ou Claude : une zone de texte en bas, les réponses qui s'affichent en streaming au-dessus.

Vous pouvez lui poser n'importe quelle question. Tout se passe en local, rien ne sort de votre machine.

## Ce que vous pouvez faire concrètement avec Gemma 4 en local

Au-delà des simples questions-réponses, l'application Ollama propose des usages qui justifient à eux seuls l'installation.

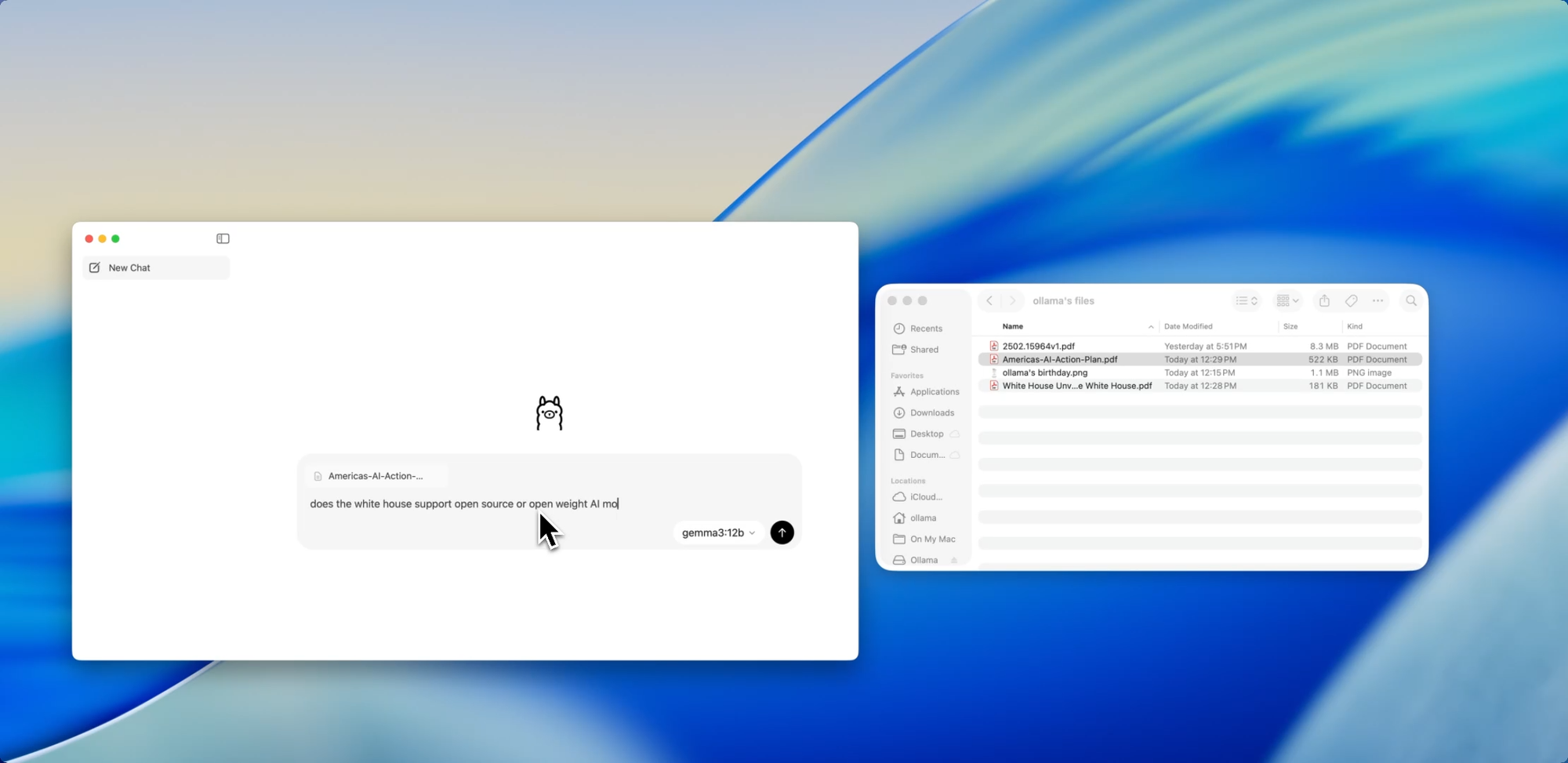

**Analyser un document confidentiel**

Glissez un fichier PDF, Markdown ou texte directement dans la fenêtre de chat. Le modèle en lit le contenu et répond à vos questions dessus. Un contrat, un rapport interne, une note stratégique : vous posez vos questions à l'IA sans qu'une seule ligne du document ne quitte votre ordinateur.

**Rédiger et reformuler**

Emails professionnels, comptes-rendus de réunion, contenus marketing, réponses à des appels d'offres : Gemma 4 gère les tâches de rédaction courante avec un niveau de qualité comparable aux outils cloud pour les usages standards.

**Travailler hors connexion**

En déplacement, dans le train, dans un lieu sans wifi fiable : votre assistant IA est disponible en permanence, sans dépendre d'une connexion internet.

**Expérimenter sans payer**

Vous voulez tester des usages IA, comprendre comment ça fonctionne, former vos équipes sur un outil concret ? Gemma 4 local est un bac à sable gratuit et sans risque. Si vous souhaitez aller plus loin en automatisant de vrais workflows professionnels avec des agents IA, la formation [Automatiser ses workflows et créer des agents IA](https://www.travelearn.fr/formation/automatiser-ses-workflows-et-crer-des-agents-ia) vous guide de la conception jusqu'au déploiement d'agents opérationnels.

## Questions fréquentes

**Mon ordinateur est-il assez puissant ?**

Si votre ordinateur a été acheté après 2019 et dispose d'au moins 8 Go de RAM, le modèle E4B (9,6 Go) fonctionnera. Les réponses seront peut-être un peu lentes sans carte graphique dédiée, mais le modèle tournera.

**Est-ce vraiment gratuit ?**

Ollama est gratuit et open source. Gemma 4 est distribué sous licence Apache 2.0, ce qui signifie utilisation personnelle et professionnelle sans restriction. La seule dépense : l'électricité de votre ordinateur pendant les calculs.

**Est-ce que mes données sont vraiment protégées ?**

Oui. Le modèle tourne sur votre machine, les calculs se font en local, aucune requête réseau n'est envoyée lors de vos conversations. Vous pouvez couper votre wifi une fois le modèle téléchargé : ça fonctionne quand même.

**Quelle est la différence avec ChatGPT ou Claude ?**

ChatGPT et Claude sont des services cloud avec des modèles nettement plus puissants sur les tâches complexes. Les modèles locaux sont un complément, pas un remplacement. L'approche optimale : Gemma 4 en local pour les usages quotidiens et les données sensibles, un service cloud pour les tâches demandant une intelligence maximale.

**Est-ce que ça marche sur Linux ?**

L'interface graphique d'Ollama est disponible sur macOS et Windows. Sur Linux, Ollama fonctionne mais en ligne de commande uniquement, sans interface graphique native.

---

**Sources**

- [Ollama : page de téléchargement](https://ollama.com/download)

- [Ollama Library : gemma4](https://ollama.com/library/gemma4)

- [Apidog : How to Use Ollama App on Windows and Mac](https://apidog.com/blog/ollama-windows-mac-app/)

- [DatabaseMart : Intro to Ollama App v0.10.0 with Native GUI](https://www.databasemart.com/blog/intro-to-ollama-app-v0100)

- [LeetLLM : Run Gemma 4 Locally with Ollama](https://leetllm.com/blog/run-gemma4-local-ollama)

- [Apidog : How to run Gemma 4 locally with Ollama](https://apidog.com/blog/gemma-4-ollama-local/)