🧭 Guide GEO 2026 : être cité par les LLM

Guide complet GEO 2026 : structurer son contenu, déployer le JSON-LD, créer un llms.txt et mesurer sa visibilité dans ChatGPT, Perplexity et Gemini.

Date : 2026-03-20

Tags : Guide, GEO, LLM, Prompt Engineering, Marketing

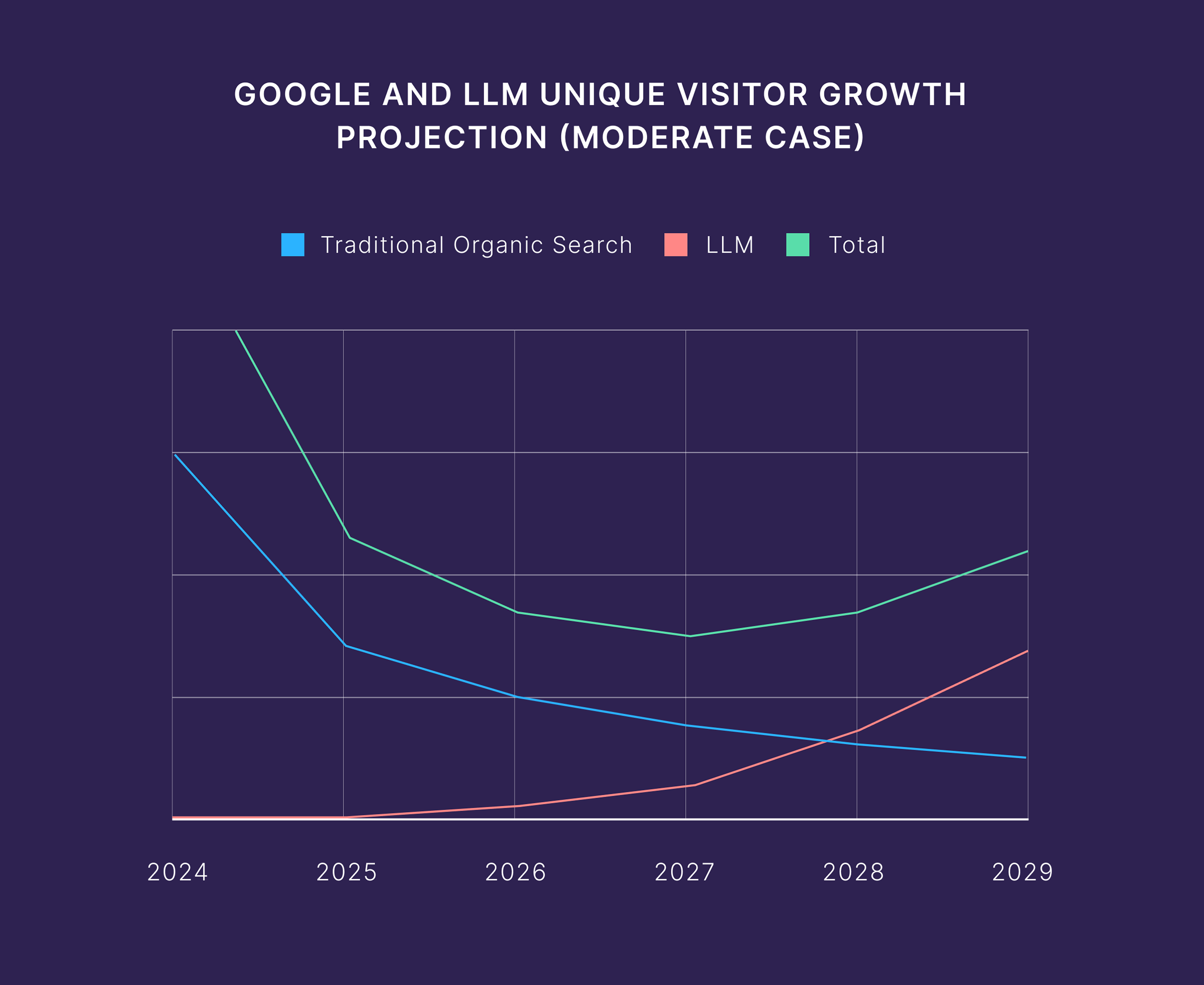

Être bien référencé sur Google ne garantit plus d'être visible là où les gens cherchent désormais des réponses : ChatGPT, Perplexity, Gemini, Claude. Le GEO (Generative Engine Optimization) est la discipline qui comble cet écart. Ce guide vous explique exactement comment l'appliquer, mis à jour avec les pratiques actives de mars 2026.

## 1. Comprendre comment les LLM sélectionnent leurs sources

Avant d'optimiser quoi que ce soit, il faut comprendre la mécanique de sélection. Un LLM ne choisit pas ses sources au hasard. Les moteurs génératifs s'appuient sur le RAG (Retrieval-Augmented Generation) : une première étape de récupération de sources pertinentes depuis le web, suivie d'une génération de réponse basée sur ces documents. Ce processus fonctionne un peu comme un moteur de recherche interne, mais optimisé pour la synthèse plutôt que pour le classement.

La conséquence directe : les LLM ne citent en moyenne que 2 à 7 domaines par réponse, contre les 10 liens bleus de Google. La concurrence pour figurer dans une réponse générée est donc bien plus sélective que pour une position en première page. Ce qui fait la différence, c'est un trio de critères que tous les modèles valorisent de manière cohérente : la pertinence du contenu par rapport à la requête, la fraîcheur de l'information, et la confiance accordée au domaine source.

Le framework E-E-A-T (Expérience, Expertise, Autorité, Fiabilité), hérité du SEO, reste central pour le GEO. Un contenu signé par un auteur identifié, avec des citations fiables et mis à jour régulièrement, surclasse un contenu superficiel ou anonyme. En pratique : signez vos articles avec un vrai nom, datez vos mises à jour de façon visible, et citez des sources sérieuses quand vous avancez des chiffres.

La structure l'emporte sur le volume : les LLM extraient des fragments de texte via des systèmes RAG, ils ne lisent pas un article dans son intégralité. C'est donc votre architecture de contenu qui détermine si l'IA vous trouve et vous cite, indépendamment de votre position sur Google. Un article de 3000 mots mal balisé sera moins cité qu'une page de 800 mots avec des titres clairs, des listes et un tableau de données.

| Critère de sélection LLM | Ce que le modèle évalue | Comment l'optimiser |

|---|---|---|

| Pertinence | Correspondance avec l'intention de la requête | H2 interrogatifs, réponse directe en premier |

| Fraîcheur | Date de publication et de mise à jour | `dateModified` en JSON-LD, mention de l'année dans le titre |

| Autorité E-E-A-T | Identité auteur, backlinks, mentions presse | Schema `Person` + `sameAs`, citations institutionnelles |

| Données originales | Chiffres propres, études, benchmarks | Tableaux de données, résultats propriétaires |

| Lisibilité machine | HTML propre, structure sémantique | SSR ou prerender, JSON-LD, `llms.txt` |

| Densité sémantique | Entités nommées, concepts liés | Nesting JSON-LD, links `sameAs`, FAQ structurée |

## 2. Structurer son contenu pour être extrait par un LLM

C'est le levier le plus immédiatement actionnable. Il ne s'agit pas de réécrire tout son site, mais d'appliquer quelques principes d'architecture à chaque article.

**Règle fondamentale : répondre en premier, argumenter ensuite.** Les 40 à 60 premiers mots après chaque titre H2 doivent répondre directement à la question posée. C'est l'inverse du style journalistique classique (contexte, développement, conclusion). Les LLM extraient souvent le début d'une section pour générer leur réponse : si vous commencez par le contexte, vous ratez la fenêtre d'extraction.

**Ajouter un bloc TL;DR en début d'article.** Un résumé de 3 à 5 phrases qui synthétise la réponse complète dès les premières lignes est particulièrement apprécié des modèles. Ce n'est pas une accroche commerciale, c'est une réponse directe à l'intention de recherche. ChatGPT et Gemini privilégient les contenus avec des résumés structurés, des blocs TL;DR et des paragraphes courts.

**Formuler les H2 comme des questions.** Les LLM sont entraînés sur des corpus massifs de paires question/réponse. Un H2 formulé comme "Comment fonctionne X ?" signale explicitement au modèle que la section qui suit contient une réponse à cette question. Il ne faut pas pour autant transformer tous les titres en questions, au risque de paraître sur-optimisé. L'essentiel est que le contenu placé juste après le titre soit directement lié à ce qui est annoncé.

**Tableaux de données : chiffres, comparatifs, benchmarks.** Une étude montre que GPT-4 passe de 16% à 54% de réponses correctes lorsque le contenu source s'appuie sur des données structurées. Un tableau avec des chiffres précis, des comparaisons claires ou des étapes numérotées est bien plus extractable qu'une liste de descriptions textuelles. Si vous avez des données originales, présentez-les systématiquement sous forme tabulaire.

**FAQ structurée en fin d'article.** Pas une FAQ décorative : des questions réelles que se posent vos lecteurs, avec des réponses courtes de 2 à 4 phrases. La FAQPage en schema est le "cheat code" du GEO : les LLM sont entraînés sur des paires question/réponse, ils récupèrent directement ce format. Combinez la section FAQ dans le texte avec le markup `FAQPage` en JSON-LD pour doubler l'impact.

## 3. Déployer les bons signaux techniques

Le fond éditorial ne suffit pas si votre site n'est techniquement pas lisible par les crawlers des LLM. C'est un angle souvent négligé, et pourtant critique.

### 3.1 Créer un fichier `llms.txt`

C'est la nouveauté technique majeure de 2025-2026. À l'image du `robots.txt` pour les moteurs de recherche classiques, le `llms.txt` est un fichier Markdown à déposer à la racine de votre domaine (`votresite.com/llms.txt`). Il guide les agents LLM en leur fournissant une carte condensée de votre contenu.

La structure du fichier `llms.txt` repose sur quelques blocs obligatoires : un H1 en première ligne pour identifier le site, suivi d'un bloc blockquote qui sert de résumé de haute autorité, souvent interprété comme un prompt système par le modèle, puis des sections Markdown détaillant les ressources principales. L'avantage : au lieu de faire crawler l'intégralité de votre site, le modèle charge un fichier léger de 2 000 à 10 000 tokens qui lui donne l'essentiel. Anthropic, Cursor et Vercel font partie des premiers adoptants, et l'adoption reste à 5-15% des sites tech en début 2026, ce qui représente une vraie opportunité de se différencier.

### 3.2 Résoudre le problème du rendu JavaScript

Si votre site est une SPA (application monopage) rendue côté client avec React, Vue ou Angular, les crawlers des LLM voient une page blanche. Le rendu côté serveur (SSR) est une condition technique critique. Un site rendu uniquement en JavaScript représente un obstacle majeur à l'indexation par les moteurs génératifs. Les solutions concrètes : migrer vers un framework SSR comme Next.js, ou utiliser un service de prerender comme Prerender.io qui génère des snapshots HTML statiques servis aux bots.

### 3.3 Configurer le `robots.txt` pour les bots IA

Les principaux crawlers LLM s'identifient avec des user agents spécifiques : `GPTBot` (OpenAI), `ClaudeBot` (Anthropic), `PerplexityBot` (Perplexity). Vérifiez que votre `robots.txt` ne les bloque pas involontairement via des règles génériques. Si vous souhaitez les autoriser explicitement, ajoutez des entrées dédiées avec `Allow: /`.

### 3.4 Implémenter le JSON-LD orienté LLM

Les LLM n'analysent pas le JSON-LD comme un parseur classique : ils l'absorbent, le mappent dans leur graphe de connaissances interne, et le réutilisent comme base factuelle lors de la génération de réponses. Le JSON-LD devient une empreinte sémantique qui aide le modèle à se souvenir de votre marque et à vous citer avec précision.

Les types de schema les plus impactants pour le GEO :

- **`Person`** avec `sameAs` vers LinkedIn, GitHub, Malt : un schema auteur lié à un profil professionnel identifiable fait traiter le contenu comme un "conseil d'expert" par le LLM. Sans schema auteur, le modèle le considère comme du "contenu anonyme" à faible confiance

- **`Organization`** avec `name`, `url`, `logo`, `sameAs` : ancre l'identité de votre marque dans le graphe de connaissances

- **`FAQPage`** : format natif pour les LLM entraînés sur des Q/A

- **`Article`** ou `BlogPosting` avec `datePublished` et `dateModified` : signal de fraîcheur direct

- **`HowTo`** pour les contenus tutoriels : décompose explicitement les étapes

La densité de schema joue un rôle mesurable : augmenter sa densité de schema de 5 à 10 fois a conduit à plus de mentions de marque dans les synthèses IA. Les LLM réutilisent ce qu'ils comprennent bien.

## 4. Construire son autorité de citation hors site

Le GEO ne se joue pas uniquement sur votre domaine. La réputation perçue par un LLM se construit aussi à partir de ce que le reste du web dit de vous.

**Présence sur Reddit.** De nombreux LLM sont entraînés sur des jeux de données incluant des discussions Reddit. Un contenu partagé sur cette plateforme qui reçoit des upvotes ou génère un engagement soutenu a davantage de chances d'être intégré dans les synthèses IA. Participez authentiquement dans les subreddits de votre niche, répondez aux questions précises avec des liens vers vos articles de fond, et évitez le spam de liens sans valeur ajoutée.

**Mentions dans la presse et les médias institutionnels.** Si votre information apparaît sur Wikipedia ou dans de grands médias avec des citations vérifiables, cela booste significativement votre crédibilité aux yeux d'une IA. Le RP numérique, les tribunes dans des médias sectoriels, les interviews de podcast qui génèrent des articles de synthèse : tout cela nourrit la perception de crédibilité d'un LLM.

**Cohérence d'entité sur tous les canaux.** Votre nom de marque, votre URL, votre description et vos profils sociaux doivent être strictement identiques partout où vous existez en ligne. Pour qu'un LLM croie en votre existence et votre légitimité, il doit pouvoir croiser vos données sur plusieurs sources indépendantes. Les liens `sameAs` dans votre JSON-LD Organization sont la colle sémantique qui relie toutes ces instances.

**Données originales et recherches propriétaires.** Les moteurs génératifs récompensent la complétude et la profondeur. Un contenu qui apporte une information nouvelle via des données originales, des benchmarks personnels ou des études internes a une valeur d'information supérieure aux contenus qui reformulent ce qui existe déjà. Si vous publiez des résultats de tests, des statistiques issues de votre activité, ou des observations terrain, vous créez un actif que les LLM ne trouvent nulle part ailleurs.

Pour aller plus loin dans la compréhension des mécanismes LLM et les appliquer concrètement à votre production de contenu, la formation [Augmenter sa productivité et créativité à l'aide de l'intelligence artificielle](https://www.travelearn.fr/formation/augmenter-sa-productivit-et-crativit-laide-de-lintelligence-artificielle) de TraveLearn (certifiée Qualiopi) couvre en profondeur le fonctionnement des modèles de langage et leur utilisation dans un contexte professionnel.

## 5. Mesurer sa visibilité GEO

Les métriques traditionnelles (clics, CTR, position Google) ne suffisent plus à mesurer l'impact réel de votre visibilité. Les nouvelles métriques à suivre sont la fréquence de citation dans les réponses LLM, la part de voix IA (AI share of voice) et le sentiment associé à vos mentions.

| Outil | Usage principal | Gratuit / Payant |

|---|---|---|

| Semrush AI Visibility Toolkit | Comparatif vs concurrents sur ChatGPT, Claude, Perplexity | Payant |

| Otterly.ai | Suivi des citations et mentions LLM | Freemium |

| Profound (AEO) | Enterprise : share of voice, sentiment, prompt tracking | Payant |

| Google Search Console | Impressions via AI Overviews Google | Gratuit |

| Logs CDN | Identification du trafic des bots IA | Gratuit (technique) |

Des résultats concrets existent déjà. Rocky Brands a enregistré 13% de nouveaux utilisateurs supplémentaires et 30% de croissance de ses revenus search après avoir implémenté des pratiques GEO. Ahrefs a constaté que le trafic provenant de LLM, bien que plus faible en volume que le search traditionnel, convertit 23 fois mieux pour leur produit SaaS.

La démarche de mesure minimale est simple : définissez 10 à 20 prompts représentatifs des questions que votre audience pose, testez-les manuellement dans ChatGPT, Perplexity et Gemini une fois par mois, et notez si votre domaine apparaît dans les réponses. C'est le minimum viable avant d'investir dans un outil dédié.

---

## FAQ

**Le GEO remplace-t-il le SEO ?**

Non. Le GEO étend le SEO, il ne le remplace pas. Le SEO traditionnel garde votre site rapide, crawlable et autoritaire, tandis que le GEO optimise pour les citations et la visibilité de marque dans les réponses LLM. Les deux disciplines partagent les mêmes fondations : contenu de qualité, données structurées, autorité de domaine.

**Combien de temps faut-il pour voir des résultats GEO ?**

Plus long que le SEO classique. Les LLM basés sur des données d'entraînement statiques mettent plusieurs mois à intégrer de nouveaux contenus. Les LLM avec recherche en temps réel (ChatGPT avec browsing, Perplexity) peuvent vous citer en quelques jours si votre contenu est bien structuré et accessible. Comptez 1 à 3 mois pour observer des changements mesurables.

**Mon site WordPress est-il compatible avec le GEO ?**

Oui, à condition que les pages soient rendues en HTML côté serveur (ce que WordPress fait nativement) et que vous ajoutiez un plugin de schema markup comme Yoast ou RankMath pour le JSON-LD. Les SPA (React, Vue) sans SSR sont les cas les plus problématiques.

**Le `llms.txt` est-il obligatoire ?**

Non, mais c'est un avantage compétitif significatif en 2026 vu son faible taux d'adoption actuel. Il ne coûte rien à implémenter : un simple fichier Markdown à déposer à la racine de votre domaine.

**Faut-il optimiser différemment selon le LLM (ChatGPT vs Perplexity vs Gemini) ?**

Oui, à la marge. ChatGPT favorise le contenu à fort signal E-E-A-T avec des auteurs nommés et des données structurées. Perplexity apprécie les citations transparentes et une structure éditoriale claire. En pratique, les bonnes pratiques GEO de base couvrent l'essentiel pour tous les moteurs. L'optimisation par plateforme devient pertinente quand vous avez déjà couvert les fondamentaux.

---

**Sources**

- [Backlinko – GEO: How to Win in AI Search](https://backlinko.com/generative-engine-optimization-geo) (mis à jour fév. 2026)

- [Profound – 10-Step GEO Framework](https://www.tryprofound.com/guides/generative-engine-optimization-geo-guide-2025)

- [Averi.ai – 2026 State of GEO and LLM Optimization](https://www.averi.ai/guides/2026-state-geo-llm-optimization)

- [EthicalSEO – Technical Guide to Optimizing Content for LLMs](https://ethicalseo.io/blog/optimizing-content-for-llms)

- [Webscraft – llms.txt Complete Guide 2026](https://webscraft.org/blog/llmstxt-povniy-gayd-dlya-vebrozrobnikiv-2026?lang=en)

- [Szymon Slowik – JSON-LD for LLM SEO](https://www.szymonslowik.com/json-ld-for-llm-seo/)

- [Digidop – Structured Data for SEO and GEO 2026](https://www.digidop.com/blog/structured-data-secret-weapon-seo)