🤖 Gemma 4 : Google lance ses modèles open source les plus puissants à ce jour

Gemma 4 : 4 modèles open source Apache 2.0 de Google DeepMind, 31B en top 3 mondial, 400M téléchargements cumulés, conçus pour agents IA et usage offline.

Date : 2026-04-05

Tags : Google, Gemini, LLM, Open Source, Agent IA

*Gemma 4 par Google DeepMind. © Google*

Le 2 avril 2026, Google DeepMind a sorti Gemma 4 sans crier gare, en plein week-end de Pâques. Quatre modèles open source, une licence Apache 2.0 sans restriction, des benchmarks qui ridiculisent des modèles vingt fois plus gros. Pour les développeurs, les chercheurs et les entreprises qui veulent une IA souveraine tournant sur leur propre matériel, c'est probablement l'annonce la plus importante du trimestre.

## Qu'est-ce que Gemma 4, exactement ?

Gemma 4 est la quatrième génération de la famille de modèles open source de Google DeepMind. Elle est construite sur la même base de recherche que Gemini 3, le modèle propriétaire haut de gamme de Google, mais elle est conçue pour tourner sur votre infrastructure, pas sur les serveurs de Google.

La famille se décline en quatre tailles : Effective 2B (E2B), Effective 4B (E4B), 26B Mixture of Experts (MoE) et 31B Dense. Le préfixe "E" signifie "paramètres effectifs" : les modèles E2B et E4B utilisent une technique appelée "Per-Layer Embeddings" qui injecte un signal d'embedding secondaire dans chaque couche du décodeur. Le résultat, ce sont des modèles plus petits en apparence mais plus performants à l'usage réel.

Le 31B Dense affiche 85,2 % sur MMLU Pro et 89,2 % sur AIME 2026. Le 26B MoE se classe 6e sur Arena AI avec seulement 3,8 milliards de paramètres actifs. Pour situer la progression : le score BigBench Extra Hard de Gemma 3 était de 19,3 % ; le 31B Gemma 4 atteint 74,4 %. C'est un bond qui n'a pas d'équivalent dans l'histoire des modèles open source sur une seule génération.

| Modèle | Paramètres actifs | Contexte | AIME 2026 | Codeforces ELO | Matériel cible |

|---|---|---|---|---|---|

| E2B | 2,3 Md | 128K tokens | n/c | n/c | Smartphone |

| E4B | 4,5 Md | 128K tokens | n/c | n/c | Laptop 8 Go RAM |

| 26B MoE | 3,8 Md actifs | 256K tokens | 88,3 % | n/c | GPU 24 Go (Q4) |

| 31B Dense | 31 Md | 256K tokens | 89,2 % | 2150 | H100 80 Go |

> "Gemma 4 offre un niveau d'intelligence par paramètre sans précédent. C'est notre réponse à ce dont les innovateurs ont besoin pour repousser les limites de l'IA."

> — Clement Farabet, VP of Research, Google DeepMind

## Pourquoi la licence Apache 2.0 change tout pour les professionnels

Les versions précédentes de Gemma utilisaient une licence personnalisée avec des restrictions sur l'usage commercial et des politiques de contenu imposées. Gemma 4 passe sous Apache 2.0, la même licence permissive que Qwen 3.5, plus ouverte que la licence communautaire de Llama 4. Cela signifie concrètement : pas de limite sur les utilisateurs actifs mensuels, pas d'application d'une politique d'usage acceptable, liberté totale pour les déploiements souverains et commerciaux.

Depuis le lancement de la première génération Gemma, les développeurs ont téléchargé les modèles plus de 400 millions de fois et ont construit plus de 100 000 variantes dans l'écosystème Gemmaverse. Avec Apache 2.0, ce momentum va s'accélérer : les entreprises qui hésitaient à construire sur Gemma pour des raisons de sécurité juridique n'ont plus d'obstacle.

Pour les professionnels qui automatisent leurs processus métier, c'est une ouverture concrète. Déployer un agent IA sur votre propre infrastructure, sans envoyer vos données à Google, sans abonnement, sans limite d'appels : c'est exactement ce que Gemma 4 rend possible sur du matériel standard. Si vous cherchez à comprendre comment intégrer ce type de modèle dans des workflows opérationnels, la formation [Automatiser ses workflows et créer des agents IA](https://www.travelearn.fr/formation/automatiser-ses-workflows-et-crer-des-agents-ia) de TraveLearn couvre précisément la conception d'agents autonomes avec mémoire, logique et intégration d'API, en partant de zéro.

## Gemma 4 face à la concurrence : où en est-on vraiment ?

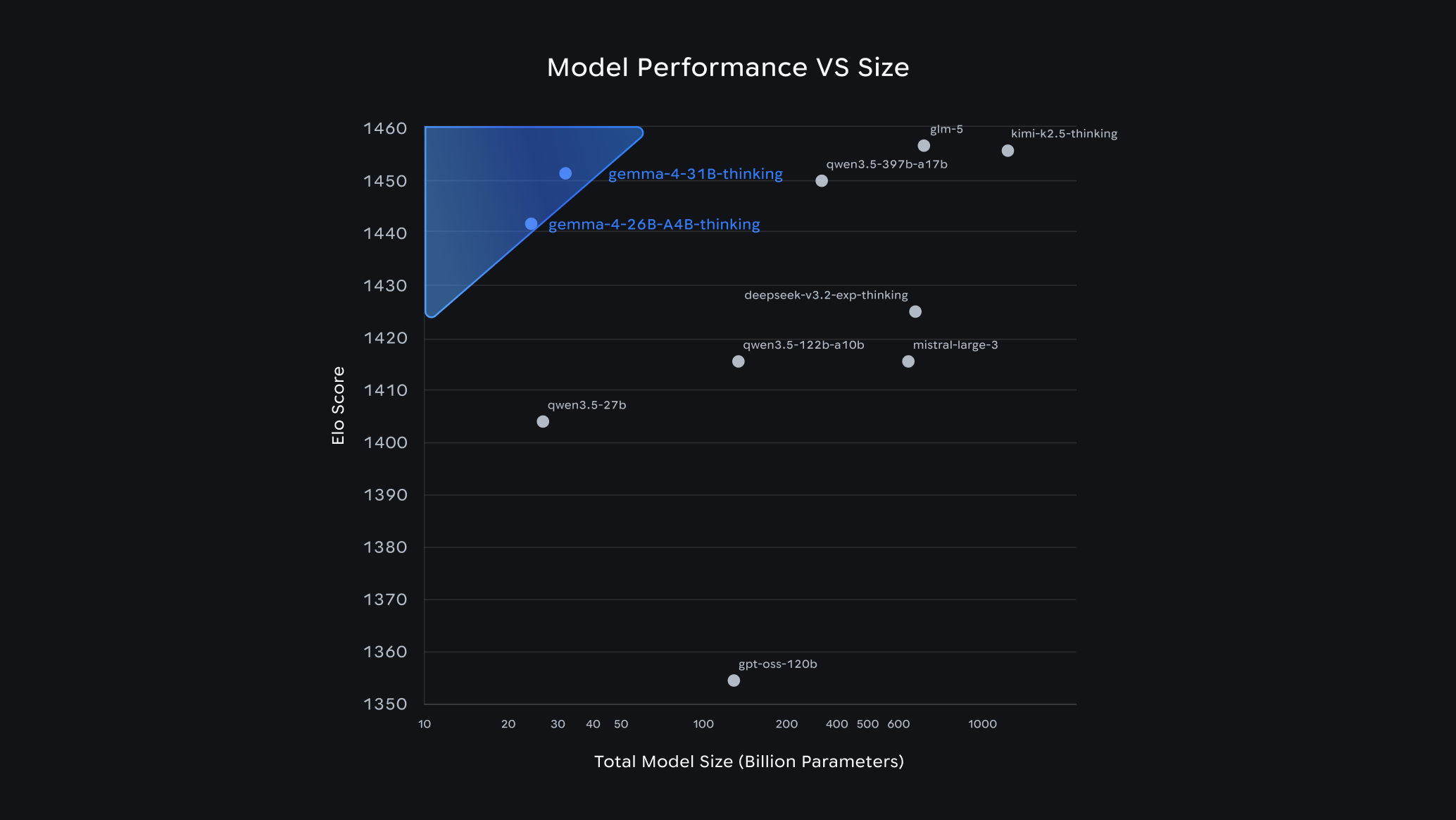

*Classement Arena.ai des modèles open source au 1er avril 2026. © Google*

La honnêteté s'impose. Le 31B se place au rang 3 sur le classement Arena AI des modèles ouverts, avec des scores forts en mathématiques (AIME 2026 : 89,2 %), en connaissance scientifique (GPQA Diamond : 84,3 %) et en programmation compétitive (LiveCodeBench v6 : 80,0 %). C'est excellent pour sa taille.

Mais Gemma 4 reste légèrement derrière Qwen 3.5 d'Alibaba, GLM-5 de Zhipu AI et Kimi K2.5 de Moonshot AI dans les comparaisons globales. Les modèles chinois ont établi des benchmarks très élevés avec des architectures plus larges. Le 31B de Gemma ne prétend pas battre un modèle à 400 Md de paramètres : il prétend être le meilleur pour sa classe de taille.

Sur le côté agentique, Gemma 4 intègre nativement le function calling, la sortie JSON structurée, la planification multi-étapes et un mode de raisonnement étendu configurable. Il peut aussi produire des bounding boxes pour la détection d'éléments d'interface, utile pour les agents d'automatisation de navigateur et de lecture d'écran. Les poids des modèles sont disponibles immédiatement via Hugging Face, Kaggle et Ollama, avec une prise en charge dès le premier jour de Hugging Face Transformers, vLLM, llama.cpp, MLX et LM Studio. Pour le cloud, Google propose des déploiements via Vertex AI, Cloud Run et Google Kubernetes Engine.

---

**Sources**

- [Gemma 4 — Google Keyword Blog](https://blog.google/innovation-and-ai/technology/developers-tools/gemma-4/)

- [Gemma 4 — Google DeepMind](https://deepmind.google/models/gemma/gemma-4/)

- [Gemma 4 : New Open Source LLMs — Trending Topics](https://www.trendingtopics.eu/google-gemma-4-launch/)

- [What Is Google Gemma 4? — WaveSpeedAI](https://wavespeed.ai/blog/posts/what-is-google-gemma-4/)

- [Google Gemma 4 Developer Guide — Lushbinary](https://www.lushbinary.com/blog/gemma-4-developer-guide-benchmarks-architecture-local-deployment-2026/)