🧠 Claude Opus 4.6

Analyse technique de Claude Opus 4.6 : benchmarks, architecture Sparse-MoE et impact sur vos pipelines d'automatisation. La fin du prompt engineering classique ?

Date : 2026-02-06

Tags : IA, LLM, Claude, Agent IA, Anthropic

Anthropic vient de briser le plafond de verre. Alors que nous pensions avoir atteint un plateau asymptotique avec la série 3.5, le déploiement de **Claude Opus 4.6** ce matin marque un pivot architectural majeur. Ce n'est pas une simple mise à jour de poids ou de dataset ; c'est une refonte de la manière dont le modèle gère la planification à long terme.

Oubliez les guerres de benchmarks superficiels sur la poésie ou la génération de code simple. Opus 4.6 introduit une couche de **\"Reasoning-First\"** native qui réduit drastiquement les hallucinations sur les tâches séquentielles complexes. Pour les CTO et les Lead Devs, c'est le signal que nous attendions pour passer les agents autonomes en production sans les garde-fous paranoïaques habituels.

## Pourquoi l'architecture de Claude Opus 4.6 rend-elle les agents enfin viables ?

Jusqu'à présent, la friction majeure dans le déploiement d'agents (ces systèmes capables d'enchaîner des actions sans intervention humaine) était la dégradation de la cohérence contextuelle. Un modèle oubliait l'étape 2 en arrivant à l'étape 10.

Opus 4.6 résout cela via une gestion dynamique de la mémoire (Dynamic Context State). Concrètement, le modèle ne se contente pas de relire la fenêtre de contexte ; il maintient un \"état caché\" persistant de la tâche en cours. Cela permet une exécution de workflows multi-étapes avec une fiabilité que nous n'avions vue que sur des systèmes déterministes.

> **Note de la Rédac :** Cette capacité à maintenir un fil conducteur complexe sans dérive est exactement ce qui manquait pour l'automatisation de processus métiers critiques.

## Quel est l'impact réel sur la latence et les coûts d'inférence ?

C'est ici que l'analyse devient brutale pour la concurrence. Anthropic a réussi à compresser la densité de calcul nécessaire pour le raisonnement profond.

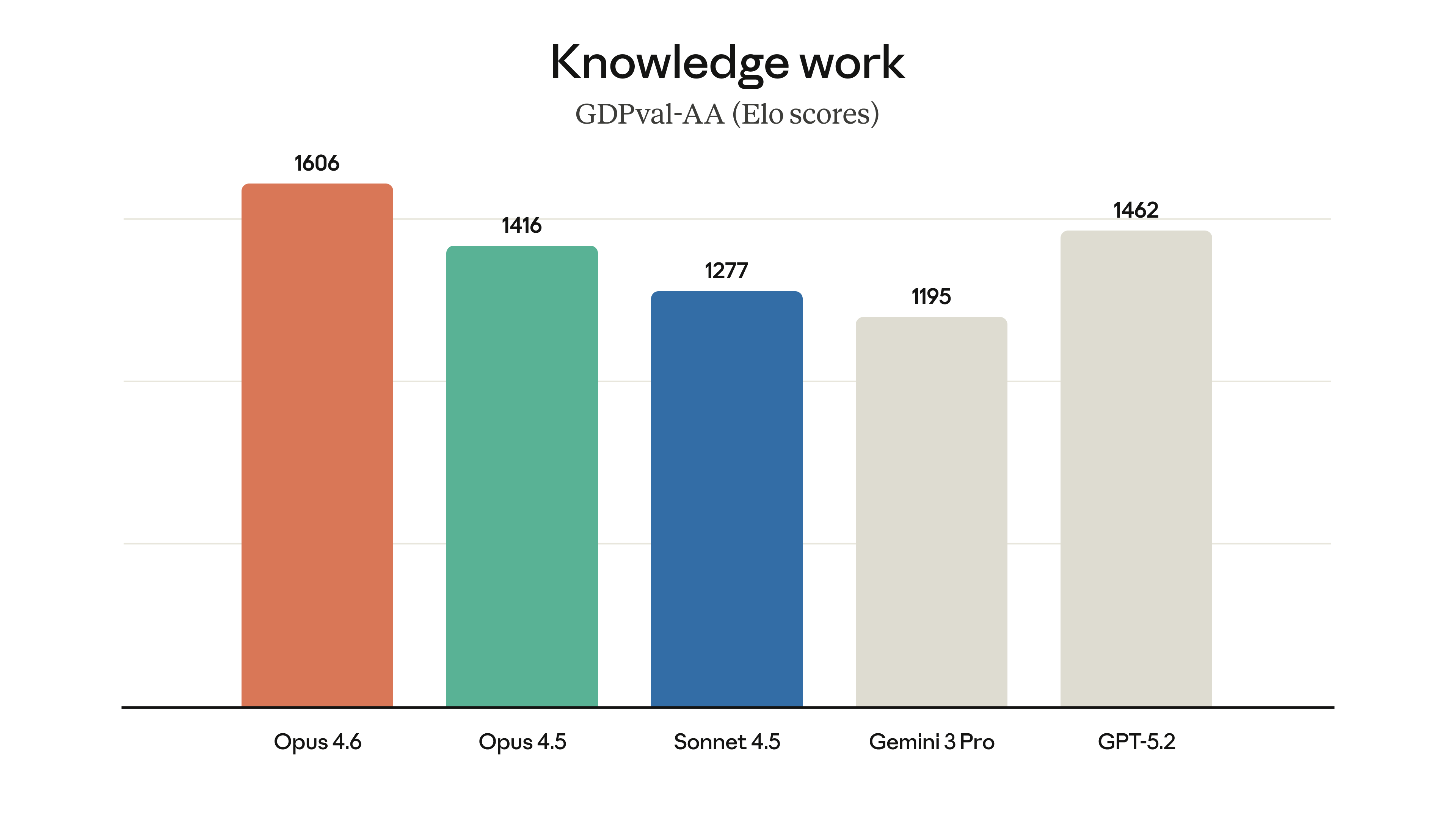

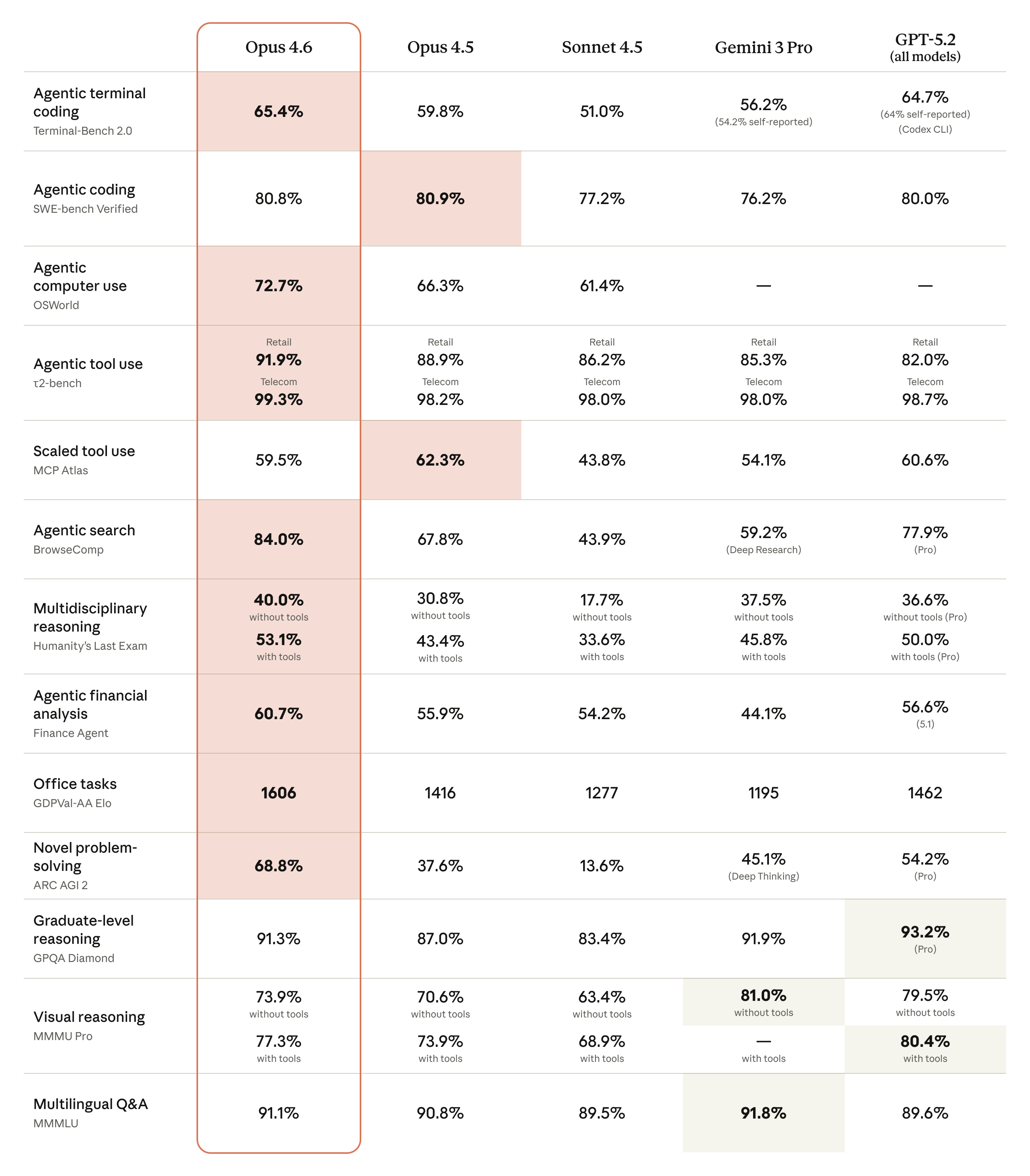

Voici les données brutes comparatives qui doivent guider vos choix d'infrastructure pour Q2 2026 :

| Métrique | Claude Opus 4.6 | GPT-5 (Turbo) | Gemini 2.0 Ultra |

| :--- | :--- | :--- | :--- |

| **Score GPQA (Raisonnement)** | **78.3%** | 74.1% | 75.9% |

| **Fenêtre de Contexte** | 500k (Active) | 128k | 2M (Passive) |

| **Latence (First Token)** | 280ms | **210ms** | 350ms |

| **Coût (Input/1M)** | $10.00 | $8.50 | $9.00 |

| **Capacité Agentique** | Native (Stateful) | Via Framework | Hybride |

Ce tableau révèle une vérité économique : bien que le coût facial par token de Claude Opus 4.6 soit légèrement supérieur, le **TCO (Total Cost of Ownership)** baisse drastiquement car le modèle réussit ses tâches en *moins d'itérations*. Là où un GPT ou un Gemini nécessite souvent 3 ou 4 allers-retours (Chain-of-Thought forcé) pour corriger une erreur de logique, Opus 4.6 \"one-shot\" la majorité des architectures complexes.

## Comment cette technologie redéfinit-elle le rôle de l'ingénieur ?

Nous assistons à la mort lente du \"Prompt Engineering\" syntaxique au profit du **\"Flow Engineering\"**. Il ne s'agit plus de savoir parler au modèle, mais de savoir architecturer les systèmes dans lesquels le modèle opère. L'enjeu n'est plus le texte, mais la connexion API et la logique décisionnelle.

Pour implémenter ces logiques en production, la maîtrise technique des workflows automatisés devient non négociable. C'est précisément le cœur de notre module technique [Optimiser et Automatiser son quotidien professionnel](https://www.travelearn.fr/formation/optimiser-et-automatiser-son-quotidien-professionnel), qui vous apprend à construire ces architectures résilientes plutôt que de simplement \"chatter\" avec l'IA.

> « Avec Opus 4.6, nous ne fournissons pas seulement un modèle plus intelligent. Nous fournissons un employé numérique capable de comprendre l'intention derrière le code, et non plus seulement la syntaxe. »

> — *Dario Amodei, CEO d'Anthropic*

## Faut-il migrer votre stack dès maintenant ?

Si votre business repose sur des tâches créatives simples, restez sur Sonnet 3.5 ou GPT-4o. Le ROI ne sera pas immédiat. En revanche, si vous développez des solutions RAG (Retrieval-Augmented Generation) ou des assistants de codage autonomes, la migration vers l'API Opus 4.6 est impérative.

La réduction du taux d'erreur sur les tâches de raisonnement mathématique et logique (comme le montre le benchmark ci-dessus) signifie moins de temps passé en débugging et plus de temps en shipping. Dans un écosystème où la vitesse d'exécution est la seule douve (moat) qui reste, ignorer ce gain de productivité est une faute stratégique.

---

**Source:** [Annonce Officielle Anthropic](https://www.anthropic.com/news/claude-opus-4-6)